«data2vec» Meta - гэта наступны крок да стварэння адной нейронавай сеткі, каб кіраваць усімі

Працягваецца гонка за стварэнне адной нейронавай сеткі, якая можа апрацоўваць некалькі відаў даных, паняцце больш агульнага штучнага інтэлекту, які не адрознівае тыпы даных, але замест гэтага можа разбіваць іх усе ў адной асноўнай структуры.

У жанры мультымадальнасці, як называюць гэтыя нейронавыя сеткі, назіраецца шквал актыўнасці, у якой розныя даныя, такія як малюнак, тэкст і аўдыё маўлення, перадаюцца праз адзін і той жа алгарытм для атрымання адзнак па розных тэстах, напрыклад распазнаванне малюнкаў, разуменне натуральнай мовы або выяўленне гаворкі.

І гэтыя амбідэкстрыя сеткі набіраюць вынікі ў эталонных тэстах ІІ. Апошняе дасягненне - гэта тое, што называецца "data2vec", распрацаванае даследчыкамі з аддзела ІІ кампаніі Meta, бацькоў Facebook, Instagram і WhatsApp.

Як пішуць навукоўцы Мета, Аляксей Баеўскі, Вэй-Нін Сю, Цяньтун Сюй, Арун Бабу, Цзятао Гу і Майкл Аўлі, у тым, каб наблізіцца да чагосьці больш падобнага да агульнай здольнасці да навучання, якую, здаецца, ахоплівае чалавечы розум.

«Хоць людзі, здаецца, вучацца падобным чынам, незалежна ад таго, як яны атрымліваюць інфармацыю - напрыклад, выкарыстоўваюць зрок або гук», - пішуць аўтары. у блогу, «у цяперашні час існуюць вялікія адрозненні ў тым, як» нейронныя сеткі апрацоўваюць розныя тыпы даных, напрыклад выявы, гаворка, тэкст «і іншыя спосабы».

«Асноўная ідэя гэтага падыходу, — заяўляюць яны з data2vec, — гэта больш агульнае навучанне: ІІ павінен быць здольны навучыцца выконваць мноства розных задач, у тым ліку зусім незнаёмых».

Генеральны дырэктар Meta, Марк Цукерберг, прапанаваў цытату аб працы, звязваючы яе з будучай Metaverse:

Захапляльны прарыў: даследаванне Meta AI пабудавала сістэму, якая вучыцца з маўлення, зроку і тэксту без неабходнасці маркіраваных навучальных дадзеных. Людзі адчуваюць свет з дапамогай спалучэння зроку, гуку і слоў, і падобныя сістэмы аднойчы могуць зразумець свет так, як мы. Усё гэта ў канчатковым выніку будзе ўбудавана ў акуляры AR з асістэнтам AI, так што, напрыклад, гэта можа дапамагчы вам прыгатаваць вячэру, заўважыўшы, калі вы прапусціце інгрэдыент, падахвоціўшы вас паменшыць ацяпленне або выканаць больш складаныя задачы.

Імя data2vec - гэта гульня з назвай праграмы для "ўбудавання" мовы распрацавана ў Google у 2013 годзе называецца «word2vec». Гэтая праграма прадказала, як словы аб'ядноўваюцца разам, і таму word2vec з'яўляецца прадстаўніком нейронавай сеткі, распрацаванай для канкрэтнага тыпу даных, у такім выпадку тэкст.

Такім чынам: Адчыніце дзверы адсека, калі ласка, HAL: AI Meta сімулюе чытанне па губах

У выпадку з data2vec, аднак, Баеўскі і яго калегі выкарыстоўваюць стандартную версію таго, што называецца Transformer, распрацаваную Ашышам Васвані і яго калегамі. у Google у 2017 годзе і пашырэнне яго для выкарыстання для некалькіх тыпаў даных.

Нейронавая сетка Transformer першапачаткова была распрацавана для моўных задач, але з тых часоў яна была шырока адаптавана для многіх відаў даных. Баеўскі і інш. паказваюць, што Transformer можа выкарыстоўвацца для апрацоўкі розных відаў даных без змены, а навучаная нейронная сетка, якая атрымлівае вынікі, можа выконваць некалькі розных задач.

У афіцыйным артыкуле «data2vec: Агульная база для самакантрольнага навучання маўленню, зроку і мове», Баеўскі і інш., навучаюць Transformer для дадзеных малюнкаў, гукавых сігналаў маўлення і прадстаўлення мовы тэксту.

Data2vec — гэта «першы высокапрадукцыйны алгарытм з самакантролем, які працуе для некалькіх мадальнасцяў, а менавіта для маўлення, зроку і тэксту», — пішуць Баеўскі і каманда ў паведамленні ў блогу.

Вельмі агульны Transformer становіцца тым, што называецца папярэдняй падрыхтоўкай, якая затым можа быць прыменена да пэўных нейронных сетак для выканання пэўных задач. Напрыклад, аўтары выкарыстоўваюць data2vec у якасці папярэдняй падрыхтоўкі, каб абсталяваць так называемую «ViT», «трансфарматар зроку», нейронную сетку, спецыяльна распрацаваную для задач зроку, якія была ўведзена ў мінулым годзе Аляксей Дасавіцкі і яго калегі з Google.

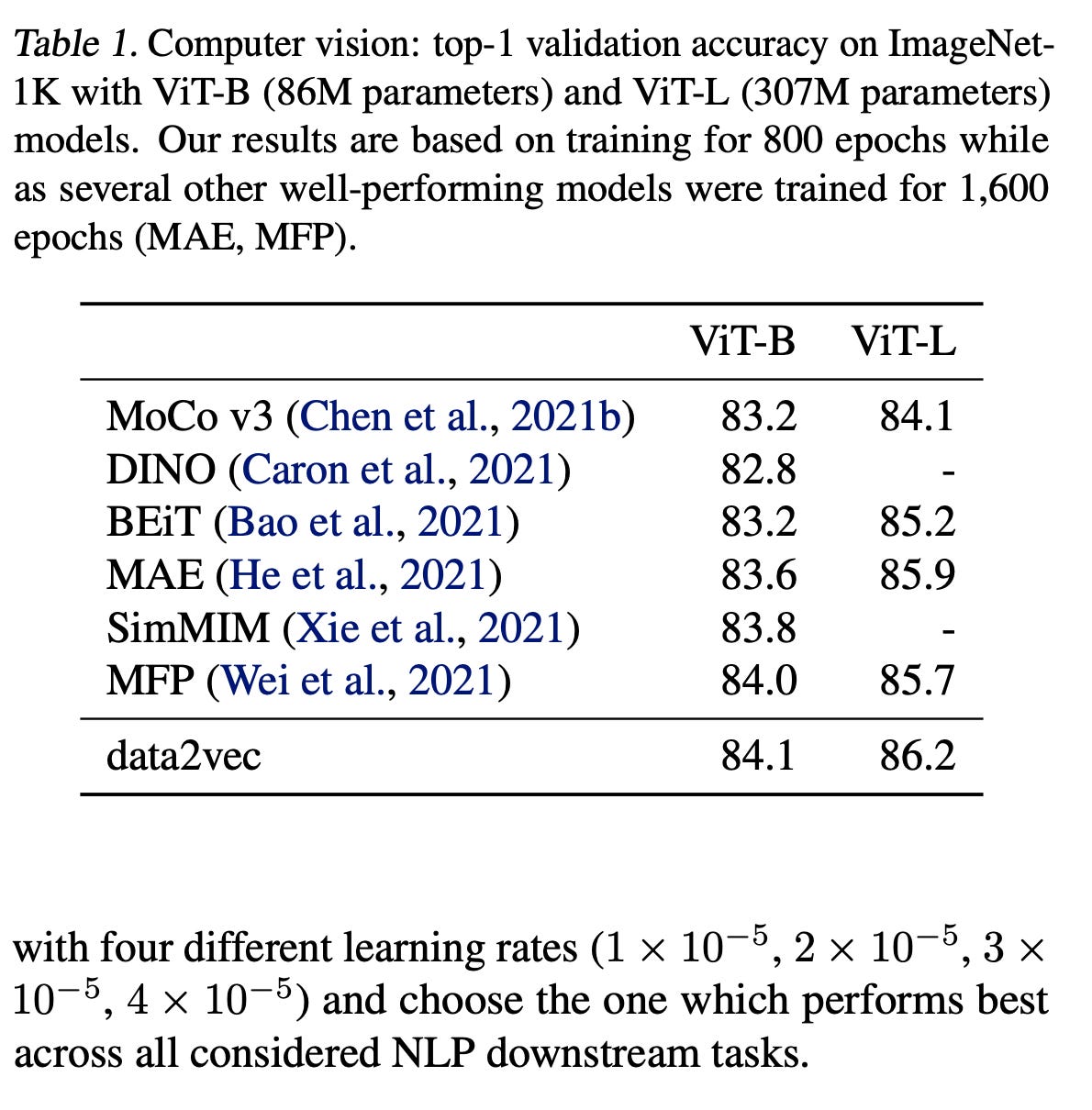

Meta паказвае лепшыя балы ў мастым конкурсе па распазнанні малюнкаў ImageNet.

мета 2022

Калі яны выкарыстоўваюцца на ViT, каб паспрабаваць вырашыць стандартны тэст ImageNet на распазнаванне малюнкаў, іх вынікі аказваюцца ў верхняй частцы пакета з дакладнасцю 84.1%, лепш, чым ацэнка 83.2%, атрыманая камандай Microsoft, якая прайшла папярэднюю падрыхтоўку ViT на чале з Ханбо Бао, у мінулым годзе.

І той жа Data2vec Transformer выводзіць вынікі, якія з'яўляюцца сучаснымі для распазнавання маўлення і якія з'яўляюцца канкурэнтаздольнымі, калі не лепшымі, для вывучэння натуральнай мовы:

Эксперыментальныя вынікі паказваюць, што data2vec эфектыўны ва ўсіх трох мадальнасцях, усталёўваючы новы стан мастацтва для ViT-B і ViT-L на ImageNet-1K, удасканальваючы найлепшую працу ў апрацоўцы маўлення па распазнанні маўлення і выконваючы на адным узроўні з RoBERTa на эталон разумення натуральнай мовы GLUE.

Сутнасць у тым, што гэта адбываецца без якіх-небудзь змяненняў нейронавай сеткі, каб быць пра выявы, і тое ж самае для прамовы і тэксту. Замест гэтага кожны тып уводу ідзе ў тую ж сетку і выконвае тую ж самую агульную задачу. Гэтая задача - тая ж задача, якую заўсёды выкарыстоўваюць сеткі Transformer, вядомая як "маскіранае прадказанне".

Такім чынам: Супермадэль Google: DeepMind Perceiver - гэта крок на шляху да машыны AI, якая можа апрацоўваць усё і ўсё

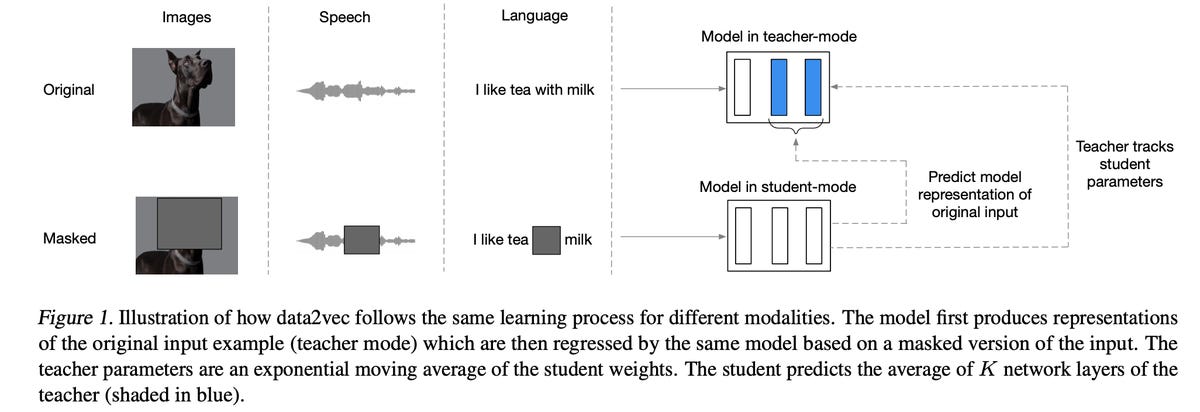

Аднак спосаб, якім data2vec выконвае замаскаванае прадказанне, вядомы як навучанне з «самастойным кантролем». Ва ўмовах самакантролю нейронная сетка навучаецца або развіваецца шляхам праходжання некалькіх этапаў.

Па-першае, сетка будуе ўяўленне аб сумеснай верагоднасці ўводу дадзеных, няхай гэта будзе выявы, гаворка або тэкст. Затым у другой версіі сеткі некаторыя з гэтых элементаў уваходных даных «замаскіраваны», застаўшыся нераскрытымі. Ён павінен аднавіць сумесную верагоднасць, якую пабудавала першая версія сеткі, што прымушае ствараць усё лепшае і лепшае прадстаўленне даных, па сутнасці запаўняючы прабелы.

Агляд падыходу data2vec.

мета 2022

Дзве сеткі, адна з поўным шаблонам сумеснай верагоднасці, і тая з няпоўнай версіяй, якую яна спрабуе завяршыць, называюцца, досыць разумна, «Настаўнік» і «Студэнт». Студэнцкая сетка спрабуе развіць сваё адчуванне даных, калі хочаце, аднаўляючы тое, чаго ўжо дасягнуў Настаўнік.

Вы можаце глядзіце код мадэляў на Github.

Як нейронная сетка працуе для настаўніка і вучня для трох вельмі розных тыпаў даных? Ключом з'яўляецца тое, што «мэта» сумеснай верагоднасці ва ўсіх трох выпадках дадзеных не з'яўляецца пэўным тыпам выхадных даных, як гэта адбываецца ў версіях Transformer для пэўнага тыпу даных, такіх як BERT Google або GPT-3 OpenAI. .

Хутчэй, data2vec захоплівае некалькі слаёў нейронавай сеткі, якія ёсць ўнутры нейронная сетка, дзесьці пасярэдзіне, якая прадстаўляе дадзеныя да таго, як яны будуць вырабляцца ў якасці канчатковага вываду.

Як пішуць аўтары, «Адно з галоўных адрозненняў нашага метаду […], акрамя выканання маскіраванага прадказання, заключаецца ў выкарыстанні мэтаў, якія заснаваныя на асерадненні некалькіх слаёў з сеткі выкладчыкаў». У прыватнасці, «мы рэгрэсуем некалькі ўяўленняў слаёў нейронавай сеткі, а не толькі верхні ўзровень», так што «data2vec прадказвае схаваныя ўяўленні ўваходных дадзеных».

Яны дадаюць: «Мы звычайна выкарыстоўваем высновы FFN [сеткі з прамым зваротам] да апошняга рэшткавага злучэння ў кожным блоку ў якасці мэты», дзе «блок» з'яўляецца трансфарматарным эквівалентам нейронавай сеткі.

Справа ў тым, што кожны тып даных, які ўваходзяць, становіцца той жа задачай для студэнцкай сеткі па аднаўленні чагосьці ўнутры нейронавай сеткі, якую стварыў Настаўнік.

Гэта асерадненне адрозніваецца ад іншых апошніх падыходаў да стварэння адной сеткі для перапрацоўкі ўсіх даных. Напрыклад, мінулым летам падраздзяленне DeepMind Google прапанавала тое, што ён называе «Персеивер», уласную мультымадальную версію Transformer. Навучанне нейронавай сеткі Perceiver - гэта больш стандартны працэс атрымання вываду, які з'яўляецца адказам на пазначаную кантраляваную задачу, такую як ImageNet. У падыходзе з самакантролем data2vec не выкарыстоўвае гэтыя пазнакі, ён проста спрабуе аднавіць унутранае прадстаўленне сеткі даных.

Яшчэ больш амбіцыйныя намаганні ляжаць у крылах. Джэф Дын, кіраўнік аддзела AI ў Google, у кастрычніку дражніў пра «Шляхі», якія, як сцвярджае Дын, з'яўляюцца «архітэктура ІІ наступнага пакалення” для мультымадальнай апрацоўкі даных.

Майце на ўвазе, што вельмі агульны падыход data2vec да адной нейронавай сеткі для некалькіх мадальнасцяў па-ранейшаму змяшчае шмат інфармацыі аб розных тыпах даных. Выява, гаворка і тэкст рыхтуюцца шляхам папярэдняй апрацоўкі даных. Такім чынам, мультымадальны аспект сеткі па-ранейшаму абапіраецца на падказкі аб даных, якія каманда называе «невялікімі кадавальнікамі ўводу для канкрэтнай мадальнасці».

Такім чынам: Google прадстаўляе 'Pathways', штучны інтэлект наступнага пакалення, які можна навучыць шматзадачнаму

«Нягледзячы на адзіны рэжым навучання, мы па-ранейшаму выкарыстоўваем экстрактары функцый і стратэгіі маскіроўкі», — тлумачаць яны.

Такім чынам, мы яшчэ не знаходзімся ў свеце, дзе нейронная сетка навучаецца без усялякага сэнсу да тыпаў уваходных даных. Мы таксама не знаходзімся ў той момант часу, калі нейронная сетка можа пабудаваць адно ўяўленне, якое спалучае ўсе розныя тыпы даных, так што нейронная сетка вывучае рэчы ў спалучэнні.

Гэты факт становіцца ясна з абмену паміж ZDNet і аўтары. ZDNet звярнуўся да Баеўскага і каманды і спытаў: «Ці ўтоеныя ўяўленні, якія служаць мэтамі, з'яўляюцца камбінаваным кадаваннем усіх трох мадальнасцяў на кожным кроку часу, ці яны звычайна толькі адна з мадальнасцяў?»

Баеўскі і каманда адказваюць, што гэта апошні выпадак, і іх reply цікава цытаваць доўга:

Схаваныя зменныя не з'яўляюцца камбінаваным кадаваннем для трох мадальнасцяў. Мы навучаем асобныя мадэлі для кожнай мадальнасці, але працэс навучання мадэлі ідэнтычны. Гэта галоўнае новаўвядзенне нашага праекта, бо раней існавалі вялікія адрозненні ў тым, як мадэлі навучаюцца ў розных мадальнасцях. Нейралогія таксама лічыць, што людзі падобным чынам вывучаюць гукі і візуальны свет. Наш праект паказвае, што навучанне з самакантролем таксама можа працаваць аднолькава для розных мадальнасцяў.

Улічваючы абмежаванні data2vec у залежнасці ад мадальнасці, нейронная сетка, якая сапраўды можа быць Адна сетка, каб кіраваць усімі застаецца тэхналогіяй будучыні.