Hvordan vi søger på nettet ændrer sig, så Google Søgning ændrer sig også

Siden starten har Googles søgemaskine tilbudt en enkel brugergrænseflade: Indtast din søgeforespørgsel i en boks, og du kan finde ud af, hvad internettet har at tilbyde dig. Resultaterne leveres stort set i form af blå tekst, hyperlinket til andre websteder. I de senere år er resultaterne blevet opgraderet med visuelle resultater, relaterede nyhedshistorier og andre former for relateret indhold.

Alligevel har Googles egen interne forskning vist, at en betydelig del af yngre internetbrugere foretrækker at søge efter information om social apps, ligesom Instagram og TikTok, over Google-produkter. Disse skiftende brugerpræferencer hjælper med at forklare, hvorfor Google udvikler sine grundlæggende søgeværktøjer til at inkludere mere multimodale kommunikationsformer og til at inkludere information fra mere "autentiske" kilder som sociale medier.

"Den måde, som folk søger og forfatter information på, var aldrig ment til at være begrænset til at skrive ord," sagde Cathy Edwards, Google VP og GM of Search, til journalister forud for Googles Search On-begivenhed onsdag. "Der er så meget information derude på nettet, som kommer i forskellige formater og fra forskellige stemmer, der har forskellig autoritet og ekspertise."

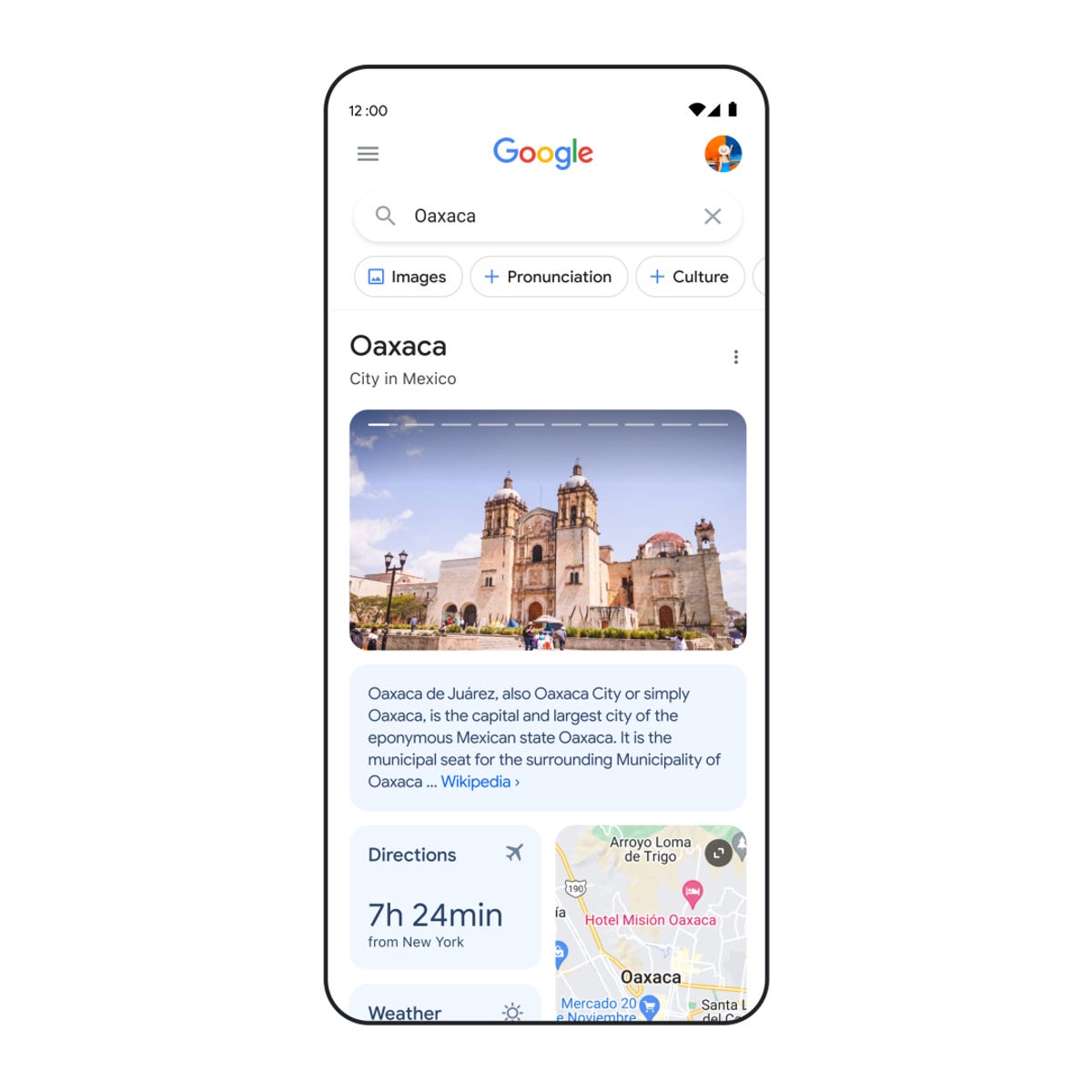

Under onsdagens begivenhed annoncerede Google, at det vil præsentere søgebrugere for indhold fra "skabere på det åbne web." Hvis en bruger f.eks. søger på navnet på en bestemt by, kan de få resultater, der inkluderer visuelle historier og korte videoer fra folk, der har besøgt dette sted.

"Vi kan virkelig se, når vi går ind i denne nye æra af søgning, at du vil være i stand til at finde præcis det, du leder efter, ved at kombinere billeder, lyde, tekst og tale, organiseret på en måde, der giver mening for dig, " sagde Edwards. "Og det hjælper dig i sidste ende med at give mening om verden."

Edwards erkendte, at "der er noget virkelig godt indhold" på TikTok, da det har reduceret barriererne for adgang til indholdsoprettelse. "Vi ser på flere måder at bringe det ind i vores søgeresultater," sagde hun.

Googles "nye æra af søgning" inkluderer også en større vægt på fællesskabsledede samtaler på fora som Reddit - en anden platform, der fungerer som et alternativ til Google Søgning. Google lancerer en ny funktion i Søgning kaldet Diskussioner i fora, der bringer disse resultater ind.

"Der er mennesker, der tydeligvis er ivrige efter at se flere resultater fra Reddit og andre fællesskabsfora i vores resultater," sagde Edwards. "Grundlæggende handler dette kun om at give folk, hvad de vil have, hvornår og hvad der er mest nyttigt for dem, når de kommer til os."

Samtidig sagde Edwards, at Google er fokuseret på at sikre, at brugere kan finde "både den autentiske information og den autoritative information" på deres søgeværktøjer.

"Vi ser også i vores forskning, at folk kommer til Google specifikt for at bekræfte deres påstande og... for at hjælpe dem med at beslutte, om de vil tro på noget, de måske har fundet på et socialt feed," sagde hun. "De stoler virkelig på, at de vil være i stand til at finde information af høj kvalitet på Google, og det tror jeg også er rigtig vigtigt."

Googles øgede fokus på multimodal søgning handler ikke kun om resultaterne – det handler også om, hvordan folk er i stand til at stille spørgsmål.

Tidligere i år introducerede Google multisearch i beta, så brugerne kan søge i et emne ved hjælp af både billeder og tekst samtidigt. Nu, i de kommende måneder, vil Google udvide denne kapacitet til mere end 70 sprog.

I mellemtiden forbedrer Google også sine Lens-funktioner. Folk bruger allerede Google til at oversætte tekst i billeder over 1 milliard gange om måneden på mere end 100 sprog. Hvis du nu peger dit kamera mod et billede med tekst på, vil Lens være i stand til at oversætte teksten og overlejre den oversatte tekst på billederne nedenunder. For eksempel, hvis du læser etiketten på en pose chips, vil teksten blive vist på dit foretrukne sprog på den pose chips.

"I stedet for at dække over den originale tekst, sletter vi den faktisk og genopbygger derefter pixels nedenunder med en AI-genereret baggrund," forklarede Edwards. “Og så overlejrer vi den oversatte tekst oven på billedet. Så det føles virkelig, som om du bare kigger på den produktpakke med den oversatte tekst.” Denne funktion lanceres senere i år.