DeepMindin 'Gato' on keskinkertainen, joten miksi he rakensivat sen?

DeepMindin ”Gato”-hermoverkko on erinomainen lukuisissa tehtävissä, kuten lohkoja pinoavien robottikäsivarsien ohjaamisessa, Atari 2600 -pelien pelaamisessa ja kuvien tekstittämisessä.

Deepmind

Maailma on tottunut näkemään otsikoita tekoälyn syvän oppimisen muotojen uusimmasta läpimurrosta. Googlen DeepMind-divisioonan viimeisin saavutus voidaan kuitenkin tiivistää seuraavasti: "Yksi AI-ohjelma, joka tekee niin ja niin paljon työtä."

Gato, kuten DeepMindin ohjelmaa kutsutaan, paljastettiin tällä viikolla niin sanottu multimodaalinen ohjelma, jolla voi pelata videopelejä, chattailla, kirjoittaa sävellyksiä, kuvatekstiä ja ohjata robottikättä pinoamaan lohkoja. Se on yksi hermoverkko, joka voi työskennellä useiden erilaisten tietojen kanssa suorittaakseen monenlaisia tehtäviä.

"Yhdellä painosarjalla Gato voi käydä dialogia, kuvatekstiä, pinota lohkoja todellisen robottikäden avulla, menestyä ihmisiä paremmin Atari-pelien pelaamisessa, navigoida simuloiduissa 3D-ympäristöissä, seurata ohjeita ja paljon muuta", kirjoittaa johtava kirjoittaja Scott Reed. ja kollegat artikkelissaan "A Generalist Agent" lähetetty Arxiv preprint -palvelimelle.

DeepMindin toinen perustaja Demis Hassabis kannusti joukkuetta, huudahtaa twiitissä, "Yleisin edustajamme vielä!! Loistavaa työtä tiimiltä!”

Myös: Uusi kokeilu: Tunteeko tekoäly todella kissoja tai koiria – tai jotain?

Ainoa saalis on, että Gato ei itse asiassa ole niin hyvä useissa tehtävissä.

Toisaalta ohjelma pystyy paremmin kuin erillinen koneoppimisohjelma ohjaamaan lohkoja pinoavaa robotti Sawyer -vartta. Toisaalta se tuottaa kuvatekstejä kuville, jotka ovat monissa tapauksissa melko huonoja. Sen kyky tavalliseen chat-dialogiin ihmiskeskustelukumppanin kanssa on samoin keskinkertainen, ja se saa joskus aikaan ristiriitaisia ja järjettömiä lausumia.

Ja sen Atari 2600 -videopelien pelaaminen jää alle useimpien omistettujen ML-ohjelmien, jotka on suunniteltu kilpailemaan vertailussa. Pelihallin oppimisympäristö.

Miksi tekisit ohjelman, joka tekee joitakin asioita melko hyvin ja joukko muita asioita ei niin hyvin? Ennakkotapaus ja odotus tekijöiden mukaan.

On olemassa ennakkotapaus, että yleisemmistä ohjelmista tulee tekoälyn huippua, ja on odotettavissa, että kasvava laskentateho korvaa tulevaisuudessa puutteita.

Yleisyydellä voi olla taipumus voittaa tekoälyssä. Kuten kirjoittajat huomauttavat viitaten tekoälytutkija Richard Suttoniin: "Historiallisesti yleisillä malleilla, jotka ovat paremmin laskentaa hyödyntäviä, on myös ollut taipumus ohittaa erikoistuneemmat toimialuekohtaiset lähestymistavat lopulta."

Kuten Sutton kirjoitti omassa blogikirjoituksessaan"Suurin opetus, joka voidaan lukea 70 vuotta kestäneestä tekoälytutkimuksesta, on se, että yleiset laskemista hyödyntävät menetelmät ovat viime kädessä tehokkaimpia ja suurella marginaalilla."

Muodollisen opinnäytetyön osana Reed ja tiimi kirjoittavat, että "testaamme täällä hypoteesia, että sellaisen agentin kouluttaminen, joka yleensä kykenee suorittamaan suuren määrän tehtäviä, on mahdollista; ja että tämä yleinen agentti voidaan mukauttaa pienellä lisätiedolla onnistumaan vielä suuremmassa määrässä tehtäviä."

Myös: Metan tekoälyvalaisin LeCun tutkii syvän oppimisen energiarajoja

Malli on tässä tapauksessa todellakin hyvin yleinen. Se on versio Transformerista, hallitsevasta huomiopohjaisesta mallista, josta on tullut perusta useille ohjelmille, mukaan lukien GPT-3. Muuntaja mallintaa jonkin elementin todennäköisyyttä, kun otetaan huomioon sitä ympäröivät elementit, kuten lauseen sanat.

Gaton tapauksessa DeepMind-tutkijat pystyvät käyttämään samaa ehdollista todennäköisyyshakua useille tietotyypeille.

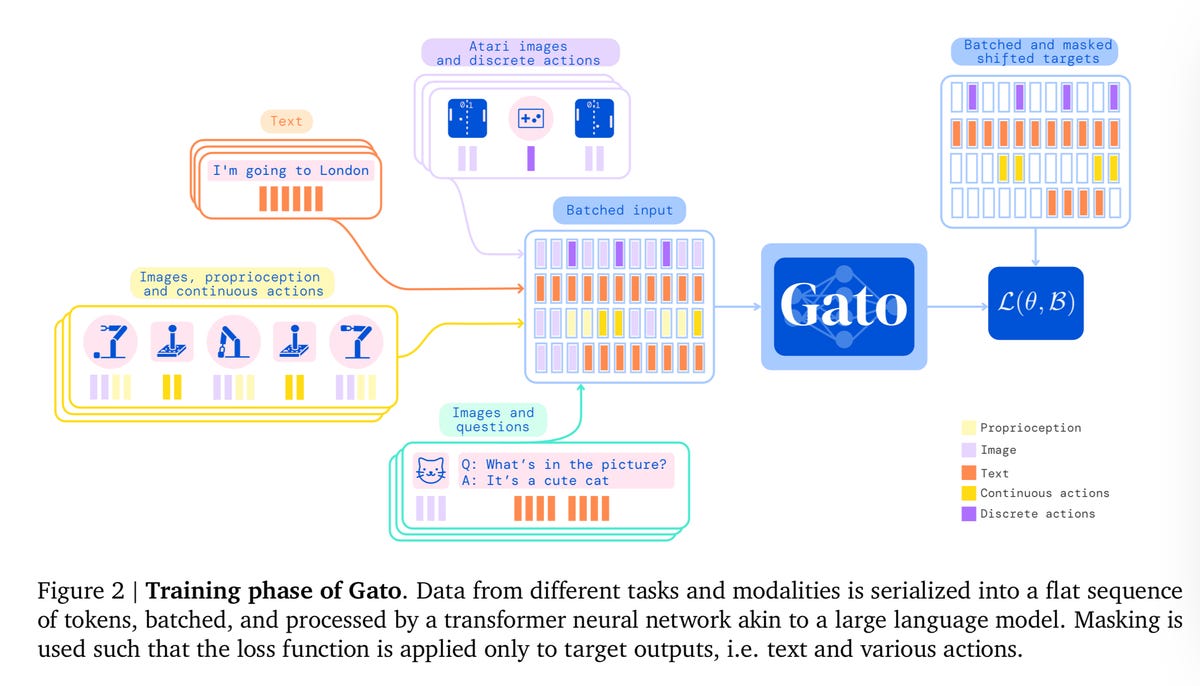

Kuten Reed ja kollegat kuvailevat Gaton valmennustehtävää,

Gaton koulutusvaiheessa data eri tehtävistä ja modaliteeteista sarjoitetaan tasaiseksi merkkijonoksi, jaetaan ja käsitellään muuntajan hermoverkolla, joka on samanlainen kuin suuri kielimalli. Tappio on peitetty siten, että Gato ennustaa vain toiminnan ja tekstikohteet.

Toisin sanoen Gato ei kohtele tokeneita eri tavalla, olivatpa ne sanoja chatissa tai liikevektoreita lohkopinoamisharjoituksessa. Ihan sama.

Gato koulutusskenaario.

Reed et ai. 2022

Reedin ja joukkueen hypoteesin sisällä on seuraus, että yhä enemmän laskentatehoa voittaa lopulta. Tällä hetkellä Gatoa rajoittaa lohkojen pinoamisen suorittavan Sawyer-robottivarren vasteaika. 1.18 miljardilla verkkoparametrilla Gato on huomattavasti pienempi kuin erittäin suuret tekoälymallit, kuten GPT-3. Kun syväoppimismallit laajenevat, päätelmien suorittaminen johtaa latenssiin, joka voi epäonnistua todellisen robotin ei-deterministisessä maailmassa.

Mutta Reed ja kollegat odottavat tämän rajan ylittyvän, kun tekoälylaitteiston käsittely nopeutuu.

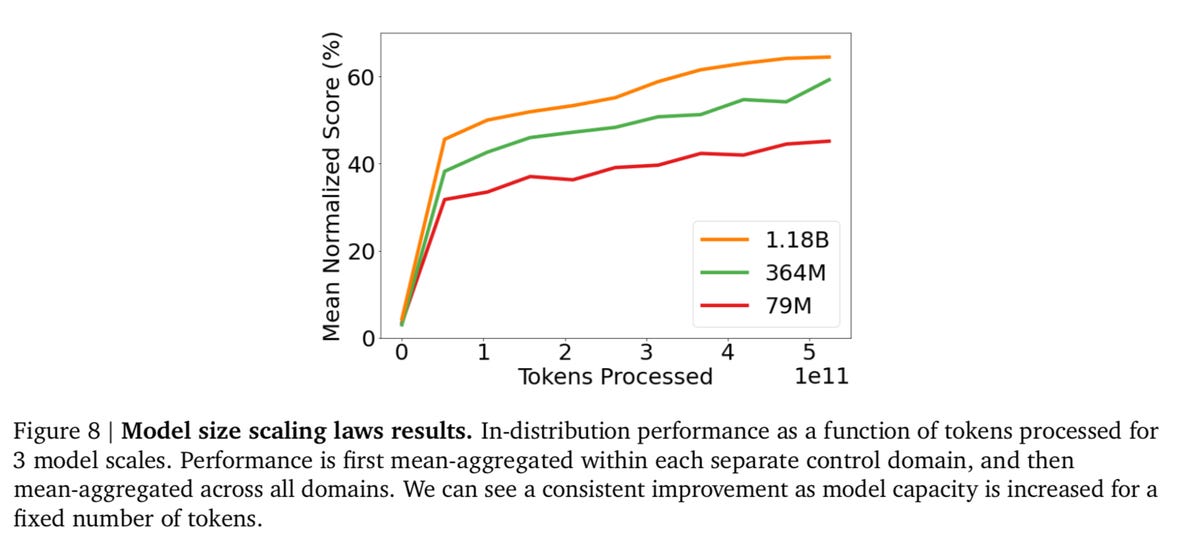

"Keskitymme koulutuksemme toimintapisteeseen mallimittakaavassa, mikä mahdollistaa reaalimaailman robottien reaaliaikaisen ohjauksen, tällä hetkellä noin 1.2 B parametreja Gaton tapauksessa", he kirjoittivat. "Kun laitteisto- ja malliarkkitehtuurit paranevat, tämä toimintapiste luonnollisesti kasvattaa mahdollista mallin kokoa ja nostaa yleismallit korkeammalle skaalauslakikäyrällä."

Siksi Gato on todella malli siitä, kuinka laskennan mittakaava tulee jatkossakin olemaan koneoppimisen kehityksen päävektori tekemällä yleisistä malleista yhä suurempia. Isompi on parempi, toisin sanoen.

Gato paranee, kun hermoverkon koko parametreissä kasvaa.

Reed et ai. 2022

Ja kirjoittajilla on tästä todisteita. Gato näyttää paranevan, kun se kasvaa. He vertaavat kaikkien vertailutehtävien keskimääräisiä pisteitä kolmen mallikoon parametrien mukaan, 79 miljoonaa, 364 miljoonaa ja päämallin, 1.18 miljardia. "Voimme nähdä, että vastaavalla token-määrällä on merkittävä suorituskyvyn parannus lisääntyneen mittakaavan kanssa", kirjoittajat kirjoittavat.

Mielenkiintoinen tulevaisuuden kysymys on, onko yleispätevä ohjelma vaarallisempi kuin muut AI-ohjelmat. Kirjoittajat viettävät paljon aikaa paperissa keskustelemalla siitä tosiasiasta, että olemassa on mahdollisia vaaroja, joita ei vielä ymmärretä hyvin.

Ajatus ohjelmasta, joka hoitaa useita tehtäviä, ehdottaa maallikolle eräänlaista inhimillistä sopeutumiskykyä, mutta se voi olla vaarallinen väärinkäsitys. "Esimerkiksi fyysinen toteutus voi johtaa siihen, että käyttäjät antropomorfoivat agenttia, mikä johtaa väärään luottamukseen järjestelmän toimintahäiriön tapauksessa tai huonojen toimijoiden hyödynnettävissä", Reed ja tiimi kirjoittavat.

"Lisäksi, vaikka verkkoalueiden välinen tiedon siirto on usein tavoite ML-tutkimuksessa, se voi aiheuttaa odottamattomia ja ei-toivottuja tuloksia, jos tietyt käyttäytymiset (esim. arcade-taistelu) siirretään väärään kontekstiin."

Siksi he kirjoittavat: "Tietämyksen siirron eettiset ja turvallisuusnäkökohdat saattavat vaatia merkittävää uutta tutkimusta yleisten järjestelmien edistyessä."

(Mielenkiintoisena sivuhuomautuksena Gato-paperissa käytetään riskien kuvaamiseen entisen Googlen AI-tutkijan Margaret Michellin ja kollegoiden suunnittelemaa mallikorttia. Mallikortit antavat tiiviin yhteenvedon siitä, mitä tekoälyohjelma on, mitä se tekee ja mitä tekijät vaikuttavat sen toimintaan. Michell kirjoitti viime vuonna, että hänet pakotettiin eroamaan Googlesta entisen kollegansa Timnit Gebrun tukemisen vuoksi, jonka tekoälyyn liittyvät eettiset huolenaiheet olivat ristiriidassa Googlen tekoälyjohtajien kanssa.)

Gato ei ole mitenkään ainutlaatuinen yleistävässä taipumuksessaan. Se on osa laajaa suuntausta yleistämiseen ja suurempiin malleihin, jotka käyttävät hevosvoimaa. Maailma sai ensimmäisen maun Googlen kallistumisesta tähän suuntaan viime kesänä Googlen Perceiver-hermoverkossa, joka yhdisti tekstimuuntajatehtävät kuviin, ääneen ja LiDAR-tilakoordinaatteihin.

Myös: Googlen supermalli: DeepMind Perceiver on askel kohti tekoälykonetta, joka pystyy käsittelemään mitä tahansa ja kaikkea

Sen vertaisten joukossa on PaLM, Pathways Language Model, Googlen tutkijat esittelivät tänä vuonna, 540 miljardin parametrin malli, joka hyödyntää uutta teknologiaa tuhansien sirujen koordinoimiseen, tunnetaan nimellä Pathways, myös Googlen keksimä. Metan tammikuussa julkaisema neuroverkko, nimeltään "data2vec", käyttää muuntajia kuvadataan, puheäänen aaltomuotoihin ja tekstikielen esityksiin yhdessä.

Uutta Gatossa näyttää olevan aikomus ottaa ei-robotiikkatehtäviin käytetty tekoäly ja työntää se robotiikkaan.

Gaton tekijät, jotka panivat merkille Pathwaysin ja muiden yleisten lähestymistapojen saavutukset, näkevät äärimmäisen saavutuksen tekoälyssä, joka voi toimia todellisessa maailmassa missä tahansa tehtävässä.

"Tulevassa työssä pitäisi pohtia, kuinka yhdistää nämä tekstiominaisuudet yhdeksi täysin yleiseksi agentiksi, joka voi toimia myös reaaliajassa todellisessa maailmassa, erilaisissa ympäristöissä ja suoritusmuodoissa."

Voit siis pitää Gatoa tärkeänä askeleena tekoälyn vaikeimman ongelman, robotiikan, ratkaisemisessa.