DeepMindдин "Гатосу" орточо, андыктан алар аны эмне үчүн курушту?

DeepMind's "Gato" нейрон тармагы блокторду чогултуучу роботторду башкаруу, Atari 2600 оюндарын ойноо жана сүрөттөрдү жазуу сыяктуу көптөгөн тапшырмаларды аткарат.

Deepmind

Дүйнө жасалма интеллекттин терең үйрөнүү формаларынын акыркы жетишкендиктери жөнүндө баш макалаларды көрүүгө көнүп калган. Google'дун DeepMind бөлүмүнүн акыркы жетишкендиги, бирок, "Бир AI программасы көп нерседе ушунчалык көп иштерди жасайт" деп жыйынтыкталышы мүмкүн.

Гато, DeepMind программасы деп аталат, ушул аптада ачылган мультимодалдык программа деп аталган программа катары, ал видео оюндарды ойной алат, баарлаша алат, композицияларды жаза алат, сүрөттөргө коштомо жазууларды жасай алат жана робот колдун блокторун башкара алат. Бул бир нече типтеги тапшырмаларды аткаруу үчүн бир нече типтеги маалыматтар менен иштей ала турган бир нейрон тармагы.

"Бир эле салмактын топтому менен Гато диалогго катыша алат, сүрөттөрдү которот, чыныгы робот колу менен блокторду стектей алат, Atari оюндарын ойноодо адамдардан ашып түшө алат, симуляцияланган 3D чөйрөлөрүндө навигациялай алат, нускамаларды аткара алат жана башкаларды жасай алат" деп жазат автор Скотт Рид. жана кесиптештери «Генералист агент» деген макаласында Arxiv алдын ала басып чыгаруу серверинде жайгаштырылган.

DeepMindдин негиздөөчүсү Демис Хассабис команданы колдоп, деп жазды твиттерде, "Биздин эң башкы агентибиз!! Командадан фантастикалык иш!”

Ошондой эле: Жаңы эксперимент: AI чындап эле мышыктарды же иттерди - же кандайдыр бир нерсени билеби?

Бир гана нерсе, Гато бир нече тапшырмаларда анчалык деле чоң эмес.

Бир жагынан алганда, программа блокторду чогулткан робот Сойер колун башкарууда атайын машина үйрөнүү программасына караганда жакшыраак иштей алат. Башка жагынан алып караганда, ал көптөгөн учурларда начар болгон сүрөттөр үчүн коштомо жазууларды чыгарат. Анын адам маектеши менен стандарттуу баарлашуу жөндөмү да ушундай эле орточо, кээде карама-каршы жана маанисиз сөздөрдү пайда кылат.

Жана анын Atari 2600 видео оюндарын ойнотуу эталондо атаандашуу үчүн иштелип чыккан ML программаларынын көбүнөн төмөн. Аркада окуу чөйрөсү.

Эмне үчүн кээ бир нерселерди жакшы аткарган, ал эми башка бир топ нерселерди анчалык жакшы аткара турган программаны жасамаксыз? Авторлордун айтымында, прецедент жана күтүү.

AIдагы эң алдыңкы программага айланган программалардын жалпы түрлөрүнүн прецеденти бар жана келечекте эсептөө кубаттуулугунун көбөйүшү кемчиликтердин ордун толтурат деген үмүт бар.

Жалпылык AIде жеңишке жетиши мүмкүн. Авторлор белгилегендей, AI окумуштуусу Ричард Саттонго шилтеме берүү менен, "Тарыхый жактан алганда, эсептөөлөрдү колдонууда жакшыраак жалпы моделдер да бара-бара адистештирилген домендик ыкмаларды басып өткөн."

Саттон жазгандай өзүнүн блогунда, "70 жылдык AI изилдөөсүнөн окула турган эң чоң сабак - бул эсептөө рычагдарын колдонгон жалпы ыкмалар акыры эң натыйжалуу жана чоң айырма менен."

Расмий тезиске салып, Рид жана команда мындай деп жазышат: “Биз бул жерде жалпысынан көп сандагы тапшырмаларды аткарууга жөндөмдүү агентти үйрөтүү мүмкүн деген гипотезаны сынап жатабыз; жана бул жалпы агент дагы көп сандагы тапшырмаларды аткаруу үчүн аз кошумча маалыматтар менен ыңгайлаштырылышы мүмкүн.

Ошондой эле: Метанын AI жарыгы ЛеКун терең үйрөнүүнүн энергетикалык чек арасын изилдейт

Бул учурда, модель, чынында эле, абдан жалпы болуп саналат. Бул Transformer версиясы, көңүл бурууга негизделген моделдин басымдуу түрү, GPT-3, анын ичинде көптөгөн программалардын негизи болуп калды. Трансформатор сүйлөмдөгү сөздөр сыяктуу аны курчап турган элементтерди эске алуу менен кандайдыр бир элементтин ыктымалдыгын моделдейт.

Gato учурда, DeepMind окумуштуулары көптөгөн маалымат түрлөрү боюнча бирдей шарттуу ыктымалдык издөөнү колдоно алышат.

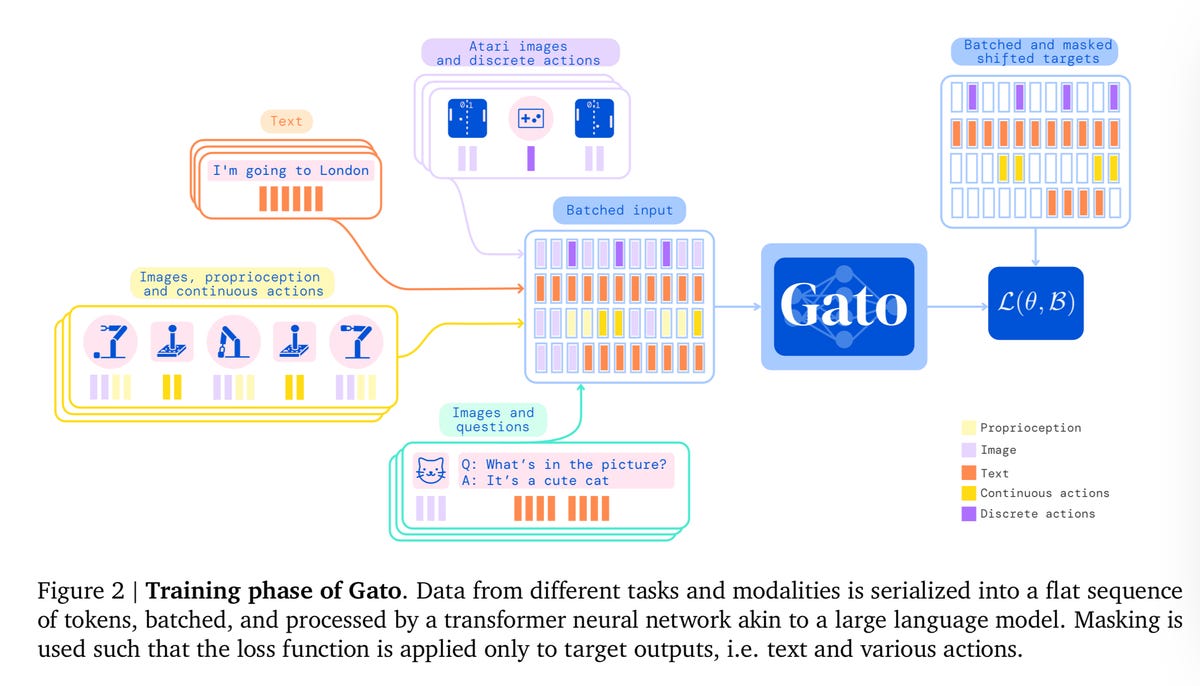

Рид жана кесиптештери Гатону окутуу милдетин сүрөттөгөндөй,

Гатонун окутуу этабында ар кандай тапшырмалардан жана модальдүүлүктөрдөн алынган маалыматтар токендердин жалпак ырааттуулугуна сериализацияланат, топтолот жана чоң тил моделине окшош трансформатордук нейрон тармагы тарабынан иштетилет. Гато иш-аракет жана текст максаттарын гана алдын ала айтуу үчүн жоготуу маскаланган.

Гато, башкача айтканда, алар чатта сөздөр болобу же блок-стекинг көнүгүүсүндө кыймылдын векторлору болобу, токендерге башкача мамиле кылбайт. Баары бирдей.

Гато машыгуу сценарийи.

Рид жана башкалар. 2022

Рид менен команданын гипотезасынын ичине көмүлгөн жыйынтык, тактап айтканда, барган сайын көбүрөөк эсептөө күчү акыры жеңет. Азыркы учурда, Гато блокторду топтоону аткарган Сойер робот колунун жооп берүү убактысы менен чектелген. 1.18 миллиард тармак параметрлери боюнча, Гато GPT-3 сыяктуу абдан чоң AI моделдеринен бир топ кичине. Терең үйрөнүү моделдери чоңойгон сайын, тыянак чыгаруу күтүү убактысына алып келет, ал реалдуу дүйнөдөгү роботтун детерминисттик эмес дүйнөсүндө ишке ашпай калышы мүмкүн.

Бирок, Рид жана кесиптештери AI жабдыктары кайра иштетүүдө ылдамдай баштагандыктан, бул чектен ашат деп күтүшөт.

"Биз окутуубузду реалдуу дүйнө роботторун реалдуу убакыт режиминде башкарууга мүмкүндүк берген моделдик масштабдагы иштөө пунктуна багыттайбыз, учурда Гатодо 1.2B параметринин тегерегинде", - деп жазган алар. "Аппараттык камсыздоо жана моделдин архитектурасы жакшырган сайын, бул операциялык чекит, албетте, мүмкүн болгон моделдин өлчөмүн көбөйтөт жана жалпы моделдерди масштабдуу мыйзам ийри сызыгынан өйдө түртөт."

Демек, Гато чындыгында жалпы моделдерди чоңураак жана чоңураак кылып, эсептөө масштабы машина үйрөнүүнүн негизги вектору болуп кала бере турган үлгү болуп саналат. Чоңураак, башкача айтканда, жакшыраак.

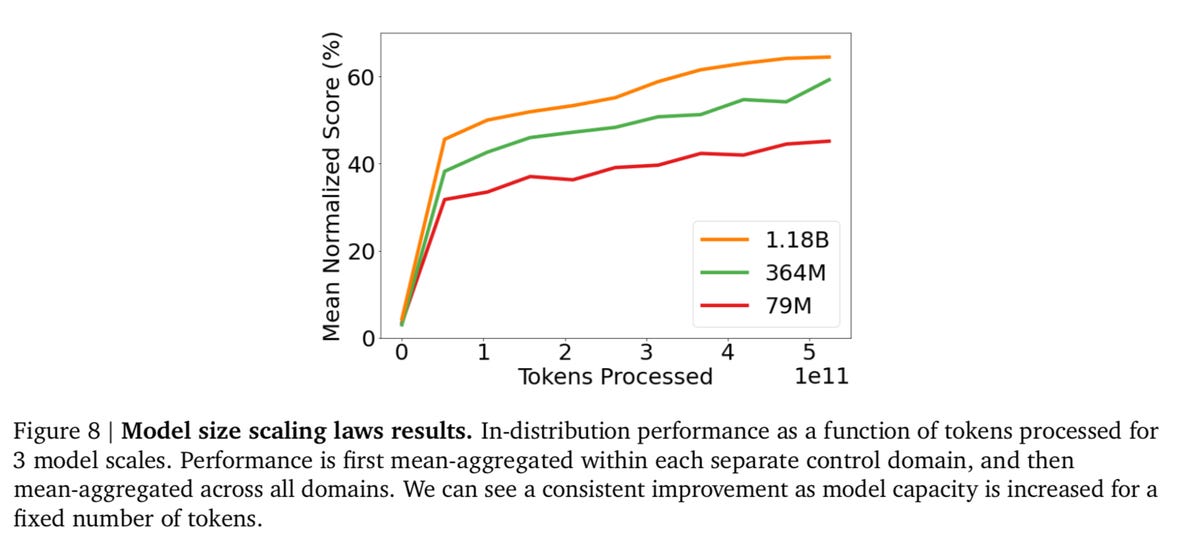

Параметрлерде нейрон тармагынын өлчөмү көбөйгөн сайын Гато жакшырат.

Рид жана башкалар. 2022

Ал эми авторлордун буга айрым далилдери бар. Гато чоңойгон сайын жакшырып баратат. Алар параметрлер боюнча моделдин үч өлчөмү үчүн бардык эталондук тапшырмалар боюнча орточо алынган упайларды салыштырышат, 79 миллион, 364 миллион жана негизги модель, 1.18 миллиард. "Биз барабар токендер саны үчүн масштабы жогорулаган менен бир кыйла натыйжалуулугун жакшыртуу бар экенин көрө алабыз", - деп жазат авторлор.

Келечектеги кызыктуу суроо - бул генералист болгон программа AI программаларынын башка түрлөрүнө караганда коркунучтуубу. Авторлор бир топ убакытты кагазга али жакшы түшүнө элек потенциалдуу коркунучтар бар экенин талкуулоого жумшашат.

Бир нече тапшырмаларды аткара турган программанын идеясы жөнөкөй адамга адамдын адаптациясынын бир түрүн сунуштайт, бирок бул кооптуу туура эмес түшүнүк болушу мүмкүн. "Мисалы, физикалык ишке ашыруу колдонуучулардын агентти антропоморфизациялоосуна алып келиши мүмкүн, бул система иштебей калган учурда ишенимсиздикке алып келиши мүмкүн же жаман актерлор тарабынан эксплуатацияланышы мүмкүн", - деп жазат Рид жана команда.

"Мындан тышкары, домендер аралык билим берүү көбүнчө ML изилдөөлөрүнүн максаты болуп саналат, ал эми кээ бир жүрүм-турумдар (мисалы, аркада оюну менен күрөшүү) туура эмес контекстке которулса, күтүлбөгөн жана каалабаган натыйжаларды жаратышы мүмкүн."

Демек, алар мындай деп жазышат: "Билим берүүнүн этика жана коопсуздук маселелери жалпы системалардын өнүгүшүнө жараша олуттуу жаңы изилдөөлөрдү талап кылышы мүмкүн."

(Кызыктуу кошумча эскертүү катары, Гато кагазында Google AI боюнча мурунку изилдөөчү Маргарет Мишелл жана кесиптештери тарабынан иштелип чыккан Модел карталары деп аталган тобокелдикти сүрөттөө үчүн схема колдонулат. Модель карталары AI программасы деген эмне экенин, ал эмнени аткарарын жана эмнени кыскача баяндап берет. факторлор анын иштешине таасир этет.Мишелл өткөн жылы ал өзүнүн мурдагы кесиптеши Тимнит Гебруну колдогону үчүн Googleдан чыгууга аргасыз болгонун жазган, анын AI боюнча этикалык тынчсыздануусу Google компаниясынын AI жетекчилигине терс таасирин тийгизген.)

Гато жалпылоо тенденциясы боюнча эч кандай уникалдуу эмес. Бул жалпылоонун кеңири тенденциясынын бир бөлүгү жана ат күчүн колдонгон чоңураак моделдер. Дүйнө Google'дун бул багытта эң биринчи даамын өткөн жайда сезди, Google'дун "Персеивер" нейрон тармагы, ал текст Transformer тапшырмаларын сүрөттөр, үн жана LiDAR мейкиндик координаттары менен айкалыштырган.

Ошондой эле: Google'дун супермодели: DeepMind Perceiver - бул бардыгын жана баарын иштете ала турган AI машинасына карай кадам.

Анын курдаштарынын арасында PaLM, Pathways Language Model, Google окумуштуулары тарабынан быйыл киргизилген, миңдеген чиптерди координациялоо үчүн жаңы технологияны колдонгон 540 миллиард параметр модели, Pathways деп аталат, Google да ойлоп тапкан. Январь айында Meta тарабынан чыгарылган "data2vec" деп аталган нейрон тармагы Трансформаторлорду сүрөт маалыматтары, кептин аудио толкундары жана текст тилинин көрүнүштөрү үчүн колдонот.

Гатодогу жаңы нерсе, робототехника эмес тапшырмалар үчүн колдонулган AIны алып, аны робототехника чөйрөсүнө түртүү ниети окшойт.

Гатонун жаратуучулары Pathways жана башка жалпылык ыкмалардын жетишкендиктерин белгилеп, AIдагы эң жогорку жетишкендикти чыныгы дүйнөдө, кандай гана болбосун тапшырмалар менен иштей тургандай көрүшөт.

"Келечектеги иш бул текст мүмкүнчүлүктөрүн реалдуу дүйнөдө, ар түрдүү чөйрөлөрдө жана ишке ашырууда реалдуу убакытта да иштей турган толук жалпы агентке кантип бириктирүү керектигин карап чыгышы керек."

Анда сиз Гатону AIнын эң татаал проблемасын, робототехникасын чечүү жолунда маанилүү кадам деп эсептесеңиз болот.