„DeepMind“ „Gato“ yra vidutiniškas, tad kodėl jie jį sukūrė?

„DeepMind“ „Gato“ neuroninis tinklas puikiai atlieka daugybę užduočių, įskaitant robotų rankų, kurios sukrauna blokus, valdymą, žaidimus „Atari 2600“ ir vaizdų antraštes.

DeepMind

Pasaulis įpratęs matyti antraštes apie naujausią gilaus mokymosi dirbtinio intelekto formų proveržį. Tačiau naujausią „Google“ padalinio „DeepMind“ laimėjimą galima apibendrinti taip: „Viena AI programa, kuri atlieka daugybę dalykų.

Gato, kaip vadinama DeepMind programa, buvo pristatytas šią savaitę kaip vadinamoji multimodalinė programa, kuri gali žaisti vaizdo žaidimus, kalbėtis, rašyti kompozicijas, užrašyti paveikslėlius ir valdyti roboto ranką, kuriant blokus. Tai vienas neuroninis tinklas, galintis dirbti su kelių rūšių duomenimis, kad galėtų atlikti įvairių rūšių užduotis.

„Naudodamas vieną svarmenų rinkinį, Gato gali užmegzti dialogą, parašyti vaizdus, sukrauti blokus su tikra roboto ranka, pranokti žmones žaidžiant Atari žaidimus, naršyti imituojamoje 3D aplinkoje, sekti instrukcijas ir dar daugiau“, – rašo pagrindinis autorius Scottas Reedas. ir kolegos savo dokumente „A Generalist Agent“ paskelbta Arxiv išankstinio spausdinimo serveryje.

„DeepMind“ įkūrėjas Demisas Hassabis pasveikino komandą, sušuko tviteryje, „Kol kas mūsų bendriausias agentas!! Nuostabus darbas iš komandos!

Taip pat: Naujas eksperimentas: ar dirbtinis intelektas tikrai pažįsta kates ar šunis – ar dar ką nors?

Vienintelis dalykas yra tas, kad Gato iš tikrųjų nėra toks puikus atliekant keletą užduočių.

Viena vertus, programa gali geriau nei speciali mašininio mokymosi programa valdyti robotą Sawyer ranką, kuri sukrauna blokus. Kita vertus, ji sukuria antraštes vaizdams, kurie daugeliu atvejų yra gana prasti. Jo gebėjimas palaikyti standartinį pokalbio dialogą su žmogaus pašnekovu yra taip pat vidutiniškas, kartais sukeliantis prieštaringus ir nesąmoningus pasisakymus.

Ir jo žaidimai „Atari 2600“ vaizdo žaidimai yra mažesni nei daugumos skirtų ML programų, skirtų konkuruoti etalonu. Arkados mokymosi aplinka.

Kodėl turėtumėte sukurti programą, kuri kai kuriuos dalykus atlieka gana gerai, o daugybę kitų dalykų – ne taip gerai? Precedentas ir lūkesčiai, pasak autorių.

Yra precedentas, kai bendresnės rūšies programos tampa pažangiausiomis AI srityje, ir tikimasi, kad didėjanti skaičiavimo galia ateityje kompensuos trūkumus.

Bendrumas gali būti linkęs triumfuoti DI. Kaip pažymi autoriai, cituodami AI mokslininką Richardą Suttoną: „Istoriškai bendrieji modeliai, kurie geriau panaudoja skaičiavimą, ilgainiui taip pat buvo linkę aplenkti labiau specializuotus, konkrečiai domenui būdingus metodus.

Kaip rašė Suttonas savo dienoraščio įraše„Didžiausia pamoka, kurią galima perskaityti iš 70 metų AI tyrimų, yra ta, kad bendrieji skaičiavimo sverto metodai galiausiai yra patys veiksmingiausi ir iš esmės.

Formalioje tezėje Reedas ir komanda rašo, kad „čia tikriname hipotezę, kad galima išmokyti agentą, kuris paprastai sugeba atlikti daugybę užduočių; ir kad šis bendras agentas gali būti pritaikytas turint mažai papildomų duomenų, kad pavyktų atlikti dar didesnį užduočių skaičių.

Taip pat: Meta AI šviestuvas LeCun tiria gilaus mokymosi energijos ribą

Šiuo atveju modelis iš tiesų yra labai bendras. Tai Transformerio versija, dominuojantis dėmesiu pagrįsto modelio tipas, tapęs daugelio programų, įskaitant GPT-3, pagrindu. Transformatorius modeliuoja tam tikro elemento tikimybę, atsižvelgiant į jį supančius elementus, pvz., žodžius sakinyje.

Gato atveju „DeepMind“ mokslininkai gali naudoti tą pačią sąlyginę tikimybių paiešką daugelyje duomenų tipų.

Kaip Reedas ir kolegos apibūdina Gato mokymo užduotį,

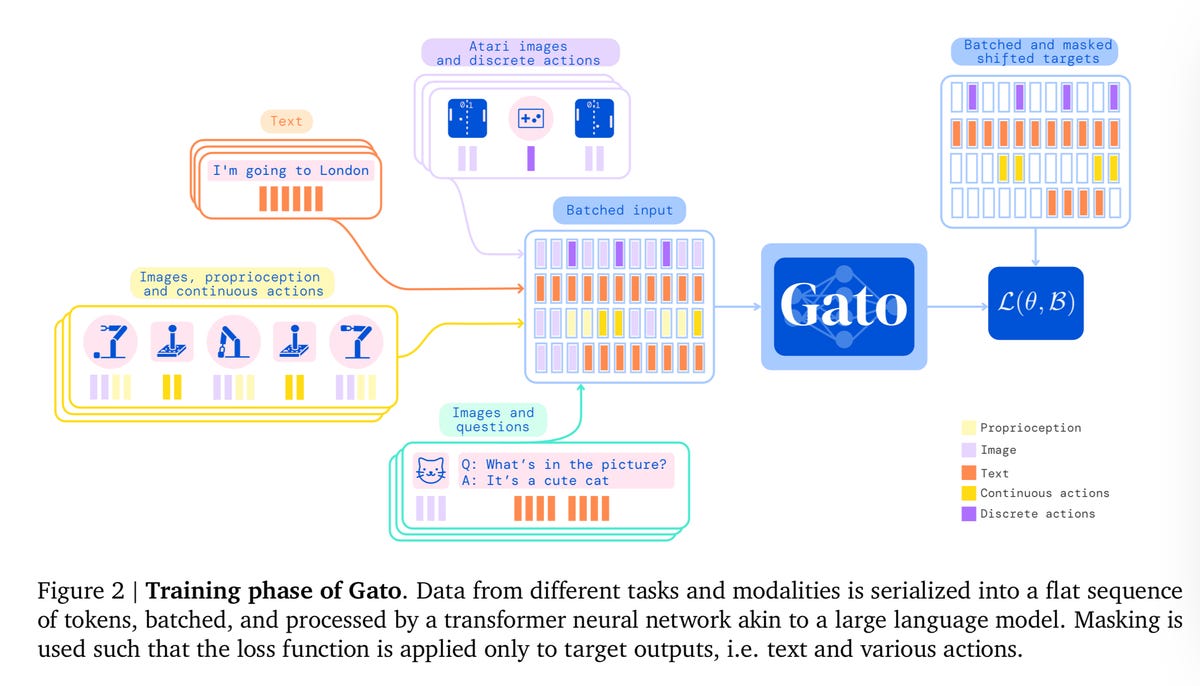

Gato mokymo etapo metu skirtingų užduočių ir būdų duomenys suskirstomi į plokščią žetonų seką, sugrupuojami ir apdorojami transformatoriaus neuroniniu tinklu, panašiu į didelį kalbos modelį. Praradimas yra užmaskuotas taip, kad Gato numato tik veiksmą ir teksto taikinius.

Kitaip tariant, Gato žetonus traktuoja skirtingai, nesvarbu, ar tai žodžiai pokalbyje, ar judėjimo vektoriai atliekant blokų krovimo pratimą. Viskas vienodai.

Gato treniruočių scenarijus.

Reed ir kt. 2022 m

Reed ir komandos hipotezė slypi iš to, kad galiausiai laimės vis daugiau skaičiavimo galių. Šiuo metu Gato riboja Sawyer roboto rankos, kuri atlieka blokų krovimą, reakcijos laikas. 1.18 milijardo tinklo parametrų Gato yra daug mažesnis nei labai dideli AI modeliai, tokie kaip GPT-3. Didėjant giluminio mokymosi modeliams, darant išvadas atsiranda delsos, kuri gali nepavykti nedeterministiniame realaus roboto pasaulyje.

Tačiau Reedas ir jo kolegos tikisi, kad ši riba bus peržengta, nes dirbtinio intelekto aparatinė įranga tampa greitesnė.

„Mokymą sutelkiame į modelio masto veikimo tašką, kuris leidžia realiu laiku valdyti realaus pasaulio robotus, šiuo metu Gato atveju apie 1.2 B parametrų“, – rašė jie. „Tobulėjant aparatūros ir modelių architektūrai, šis veikimo taškas natūraliai padidins galimo modelio dydį, o bendrieji modeliai pakels aukštyn mastelio dėsnio kreive.

Taigi „Gato“ iš tikrųjų yra pavyzdys, kaip skaičiavimo mastas ir toliau bus pagrindinis mašininio mokymosi plėtros vektorius, nes bendrieji modeliai tampa vis didesni ir didesni. Kitaip tariant, didesnis yra geriau.

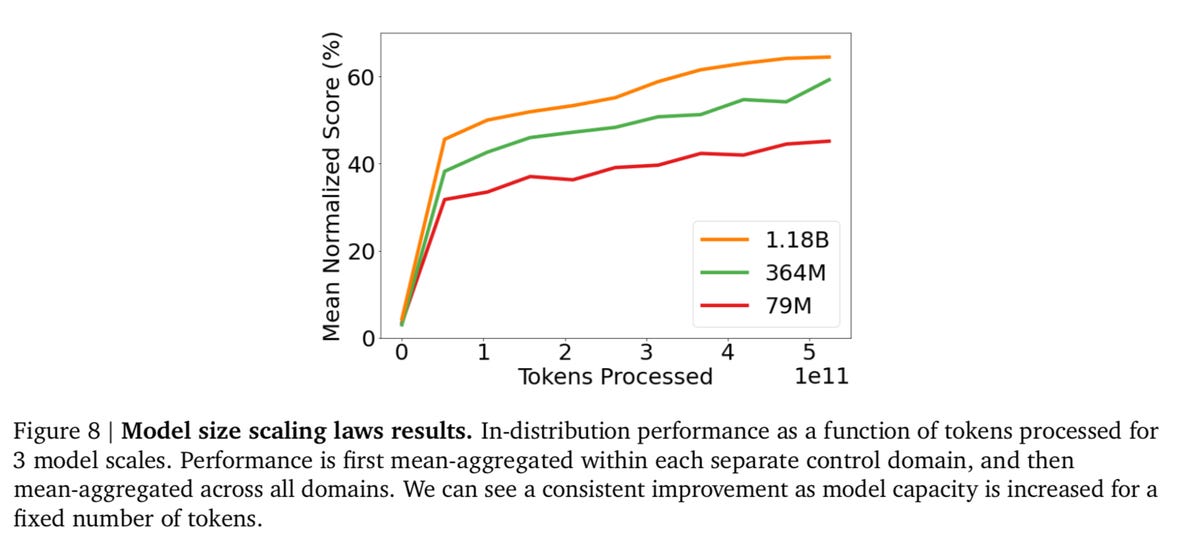

Gato gerėja, kai didėja neuroninio tinklo parametrų dydis.

Reed ir kt. 2022 m

Ir autoriai turi tam tikrų įrodymų. Atrodo, kad Gato tampa vis geresnis. Jie lygina visų etaloninių užduočių vidurkius trijų dydžių modeliams pagal parametrus – 79 mln., 364 mln., o pagrindinio modelio – 1.18 mlrd. „Matome, kad lygiaverčio žetonų skaičiaus našumas gerokai pagerėjo, padidėjus mastui“, – rašo autoriai.

Įdomus ateities klausimas yra tai, ar programa, kuri yra apibendrinta, yra pavojingesnė už kitų rūšių AI programas. Straipsnyje autoriai daug laiko praleidžia aptardami faktą, kad yra galimų pavojų, kurie dar nėra gerai suprantami.

Programos, kuri atlieka kelias užduotis, idėja pasauliečiui rodo tam tikrą žmogaus prisitaikymą, tačiau tai gali būti pavojingas klaidingas suvokimas. „Pavyzdžiui, dėl fizinio įkūnijimo naudotojai gali antropomorfizuoti agentą, o tai gali sukelti netinkamą pasitikėjimą sistemos veikimo sutrikimo atveju arba gali būti išnaudojami blogi veikėjų“, – rašo Reedas ir komanda.

„Be to, nors žinių perdavimas tarp domenų dažnai yra ML tyrimų tikslas, jis gali sukelti netikėtų ir nepageidaujamų rezultatų, jei tam tikras elgesys (pvz., arkadinių žaidimų kovos) bus perkeltas į netinkamą kontekstą.

Todėl jie rašo: „Žinių perdavimo etikos ir saugumo sumetimais gali prireikti didelių naujų tyrimų, kai bendrosios sistemos tobulėja.

(Įdomi pastaba yra tai, kad Gato dokumente naudojama buvusios Google AI tyrėjos Margaret Michell ir kolegų sukurta schema, vadinama modelių kortelėmis. Modelių kortelėse pateikiama glausti santrauka, kas yra AI programa, ką ji daro ir ką ji daro. Veiksniai turi įtakos jos veikimui. Michell praėjusiais metais rašė, kad buvo priversta pasitraukti iš „Google“ už tai, kad palaikė savo buvusį kolegą Timnitą Gebru, kurio etinis susirūpinimas dėl AI susidūrė su „Google“ AI vadovybe.)

Gato jokiu būdu nėra išskirtinis savo apibendrinimo tendencija. Tai dalis plačios apibendrinimo tendencijos ir didesnių modelių, kurie naudoja daug arklio galių. Praėjusią vasarą pasaulis pirmą kartą išbandė „Google“ pakrypimą šia kryptimi, kai „Google“ neuroninis tinklas „Perceiver“ sujungė teksto transformatoriaus užduotis su vaizdais, garsu ir LiDAR erdvinėmis koordinatėmis.

Taip pat: „Google“ supermodelis: „DeepMind Perceiver“ yra žingsnis link dirbtinio intelekto mašinos, galinčios apdoroti bet ką ir viską

Tarp savo kolegų yra PaLM, kalbos modelis „Pathways“, šiais metais pristatė „Google“ mokslininkai540 milijardų parametrų modelis, kuriame naudojama nauja technologija, skirta koordinuoti tūkstančius lustų, žinomas kaip Pathways, taip pat išrastas „Google“. Neuroninis tinklas, kurį sausį išleido „Meta“, vadinamas „data2vec“, naudoja transformatorius vaizdo duomenims, kalbos garso bangų formoms ir teksto kalbos atvaizdavimui viename.

Atrodo, kad „Gato“ naujovė yra ketinimas naudoti dirbtinį intelektą, naudojamą ne robotų užduotims, ir perkelti jį į robotikos sritį.

Gato kūrėjai, atkreipdami dėmesį į „Pathways“ laimėjimus ir kitus bendruosius metodus, mato didžiausią AI pasiekimą, kuris gali veikti realiame pasaulyje, atliekant bet kokias užduotis.

"Ateities darbe turėtų būti apsvarstyta, kaip sujungti šias teksto galimybes į vieną visiškai bendrą agentą, kuris taip pat gali veikti realiuoju laiku realiame pasaulyje, įvairiose aplinkose ir įkūnijimuose."

Tada galėtumėte laikyti Gato svarbiu žingsniu sprendžiant sudėtingiausią AI problemą – robotiką.