DeepMind 'Gato' ir viduvējs, tad kāpēc viņi to izveidoja?

DeepMind “Gato” neironu tīkls ir izcils daudzos uzdevumos, tostarp robotu roku vadīšanā, kas sakrauj blokus, spēlē Atari 2600 spēles un attēlu parakstus.

Deepmind

Pasaule ir pieradusi redzēt virsrakstus par jaunāko mākslīgā intelekta dziļo mācību formu sasniegumu. Tomēr jaunāko Google DeepMind nodaļas sasniegumu varētu apkopot šādi: "Viena AI programma, kas veic tik daudz darbu."

Gato, kā sauc DeepMind programmu, tika atklāts šonedēļ kā tā sauktā multimodāla programma, kas var spēlēt videospēles, tērzēt, rakstīt skaņdarbus, titrus attēlus un vadīt robotu roku, kas sakrauj blokus. Tas ir viens neironu tīkls, kas var strādāt ar dažāda veida datiem, lai veiktu dažāda veida uzdevumus.

"Izmantojot vienu atsvaru komplektu, Gato var iesaistīties dialogā, parakstu attēlos, sakraut blokus ar īstu robota roku, pārspēt cilvēkus, spēlējot Atari spēles, pārvietoties simulētās 3D vidēs, sekot instrukcijām un daudz ko citu," raksta vadošais autors Skots Rīds. un kolēģi savā rakstā “A Generalist Agent” publicēts Arxiv priekšdrukas serverī.

DeepMind līdzdibinātājs Demis Hassabis uzmundrināja komandu, iesaucoties tviterī, “Mūsu pagaidām vispārīgākais aģents!! Fantastisks darbs no komandas!”

Arī: Jauns eksperiments: vai AI tiešām pazīst kaķus vai suņus vai ko citu?

Vienīgais āķis ir tas, ka Gato faktiski nav tik izcils vairākos uzdevumos.

No vienas puses, programma spēj labāk nekā īpaša mašīnmācīšanās programma, lai kontrolētu robotizētu Sawyer roku, kas sakrauj blokus. No otras puses, tas veido parakstus attēliem, kas daudzos gadījumos ir diezgan slikti. Tā spēja standarta tērzēšanas dialogā ar cilvēku sarunu biedru ir tikpat viduvēja, dažreiz izraisot pretrunīgus un bezjēdzīgus izteikumus.

Un tā Atari 2600 videospēļu spēlēšana ir zemāka par lielāko daļu specializēto ML programmu, kas paredzētas, lai konkurētu etalonā. Arkādes mācību vide.

Kāpēc jums vajadzētu izveidot programmu, kas dažas lietas dara diezgan labi un daudzas citas lietas ne tik labi? Pēc autoru domām, precedents un cerības.

Pastāv precedents tam, ka vispārīgākas programmas kļūst par jaunāko AI, un ir sagaidāms, ka pieaugošais skaitļošanas jaudas apjoms nākotnē kompensēs trūkumus.

Vispārīgums AI mēdz triumfēt. Kā norāda autori, atsaucoties uz AI zinātnieku Ričardu Satonu: "Vēsturiski vispārīgie modeļi, kas labāk izmanto aprēķinus, galu galā ir pārņēmuši specializētākas jomai specifiskas pieejas."

Kā rakstīja Satons savā emuāra ierakstā, “Lielākā mācība, ko var nolasīt no 70 gadu AI izpētes, ir tāda, ka vispārējās metodes, kas izmanto aprēķinus, galu galā ir visefektīvākās un ar lielu rezervi.”

Formālā tēzē Rīds un komanda raksta, ka “mēs šeit pārbaudām hipotēzi, ka ir iespējams apmācīt aģentu, kurš kopumā spēj veikt lielu skaitu uzdevumu; un ka šo vispārējo aģentu var pielāgot ar maziem papildu datiem, lai gūtu panākumus vēl lielākā skaitā uzdevumu.

Arī: Meta AI gaismeklis LeCun pēta dziļas mācīšanās enerģijas robežas

Modelis šajā gadījumā patiešām ir ļoti vispārīgs. Tā ir transformatora versija, kas ir dominējošais uz uzmanību balstītais modelis, kas ir kļuvis par pamatu daudzām programmām, tostarp GPT-3. Transformators modelē kāda elementa varbūtību, ņemot vērā elementus, kas to ieskauj, piemēram, vārdus teikumā.

Gato gadījumā DeepMind zinātnieki var izmantot to pašu nosacīto varbūtības meklēšanu daudziem datu tipiem.

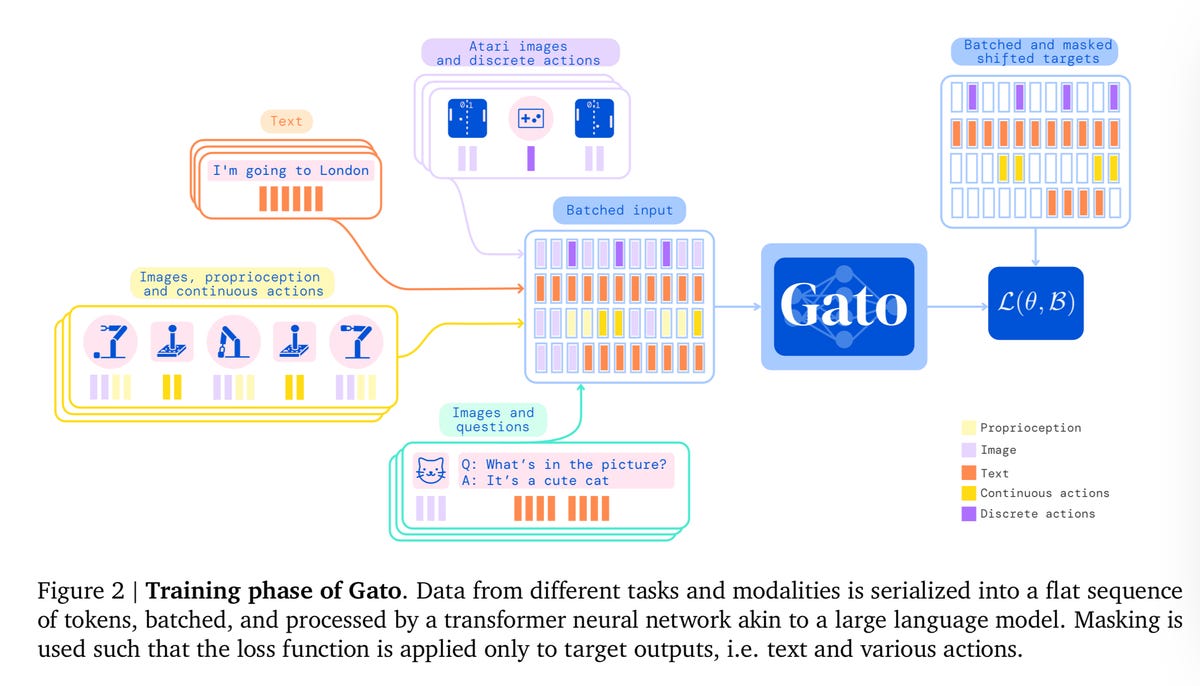

Kā Rīds un kolēģi raksturo uzdevumu apmācīt Gato,

Gato apmācības fāzē dati no dažādiem uzdevumiem un modalitātēm tiek serializēti plakanā marķieru secībā, sagrupēti un apstrādāti ar transformatora neironu tīklu, kas ir līdzīgs lielam valodas modelim. Zaudējums tiek maskēts, lai Gato paredzētu tikai darbības un teksta mērķus.

Citiem vārdiem sakot, Gato neizturas pret marķieriem atšķirīgi neatkarīgi no tā, vai tie ir vārdi tērzēšanā vai kustību vektori bloku sakraušanas vingrinājumā. Tas viss ir vienāds.

Gato apmācības scenārijs.

Rīds et al. 2022. gads

Rīda un komandas hipotēze ir apglabāta, proti, ka galu galā uzvarēs arvien vairāk skaitļošanas jaudas. Šobrīd Gato ierobežo reakcijas laiks, ko sniedz Sawyer robota roka, kas veic bloku sakraušanu. Ar 1.18 miljardiem tīkla parametru Gato ir ievērojami mazāks nekā ļoti lieli AI modeļi, piemēram, GPT-3. Tā kā dziļās mācīšanās modeļi kļūst arvien lielāki, secinājumu veikšana noved pie latentuma, kas var neizdoties reālās pasaules robota nedeterministiskajā pasaulē.

Taču Rīds un kolēģi sagaida, ka šis ierobežojums tiks pārsniegts, jo mākslīgā intelekta aparatūras apstrāde kļūst ātrāka.

"Mēs koncentrējam savu apmācību uz modeļa mēroga darbības punktu, kas ļauj reāllaikā kontrolēt reālās pasaules robotus, pašlaik Gato gadījumā aptuveni 1.2 B parametri," viņi rakstīja. "Tā kā aparatūras un modeļu arhitektūra uzlabojas, šis darbības punkts, protams, palielinās iespējamo modeļa izmēru, virzot vispārīgos modeļus augstāk mērogošanas likuma līknē."

Tādējādi Gato patiešām ir paraugs tam, kā skaitļošanas mērogs joprojām būs galvenais mašīnmācīšanās attīstības vektors, padarot vispārējos modeļus arvien lielākus un lielākus. Lielāks ir labāks, citiem vārdiem sakot.

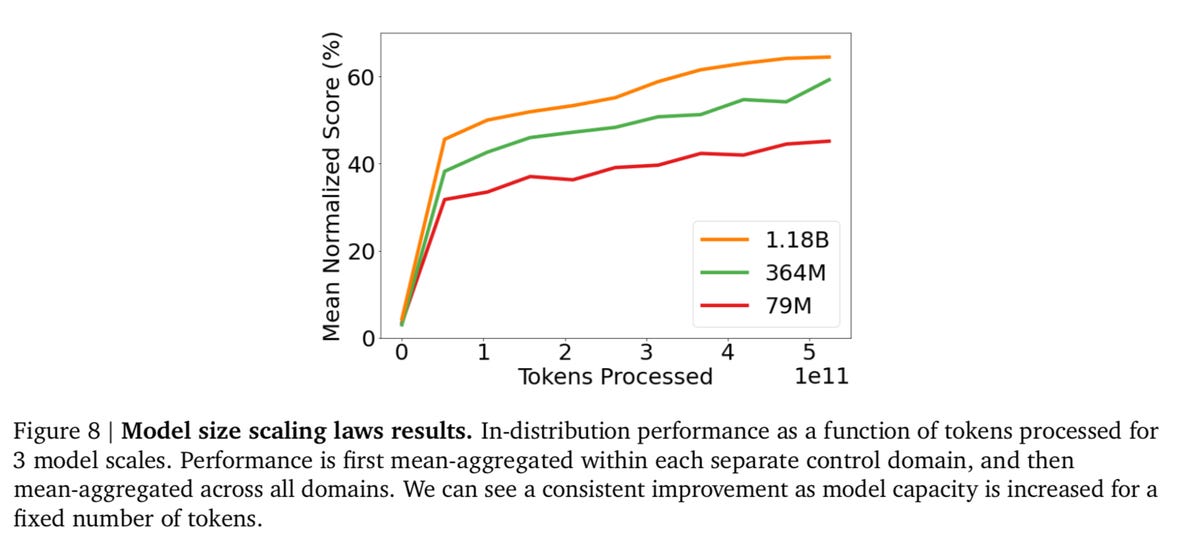

Gato kļūst labāks, palielinoties neironu tīkla izmēram parametros.

Rīds et al. 2022. gads

Un autoriem par to ir daži pierādījumi. Šķiet, ka Gato kļūst arvien labāks, jo tas kļūst lielāks. Viņi salīdzina vidējos rādītājus visos etalonuzdevumos trīs modeļu izmēriem pēc parametriem — 79 miljoni, 364 miljoni un galvenajam modelim — 1.18 miljardi. "Mēs redzam, ka līdzvērtīgam marķieru skaitam ir ievērojams veiktspējas uzlabojums ar palielinātu mērogu," raksta autori.

Interesants nākotnes jautājums ir par to, vai programma, kas ir vispārīga, ir bīstamāka nekā cita veida AI programmas. Autori rakstā pavada daudz laika, apspriežot faktu, ka pastāv potenciālās briesmas, kas vēl nav labi izprastas.

Ideja par programmu, kas apstrādā vairākus uzdevumus, liek domāt nespeciālistam par cilvēka pielāgošanās spēju, taču tā var būt bīstama nepareiza uztvere. "Piemēram, fiziska iemiesojuma dēļ lietotāji antropomorfizē aģentu, izraisot nepareizu uzticēšanos sistēmas darbības traucējumu gadījumā vai to var izmantot slikti dalībnieki," raksta Rīds un komanda.

"Turklāt, lai gan starpdomēnu zināšanu nodošana bieži vien ir mērķis ML pētniecībā, tas var radīt negaidītus un nevēlamus rezultātus, ja noteikta uzvedība (piemēram, arkādes spēļu cīņa) tiek pārnesta uz nepareizu kontekstu."

Tāpēc viņi raksta: "Zināšanu nodošanas ētikas un drošības apsvērumi var prasīt nozīmīgus jaunus pētījumus, attīstoties vispārīgām sistēmām."

(Interesanta piezīme ir tas, ka Gato dokumentā ir izmantota bijušās Google AI pētnieces Mārgaretas Mišelas un kolēģu izstrādātā shēma, ko sauca par modeļu kartēm. Modeļu kartītes sniedz īsu kopsavilkumu par to, kas ir AI programma, ko tā dara un ko tā dara. faktori ietekmē tā darbību. Pagājušajā gadā Mišela rakstīja, ka viņa bija spiesta pamest Google, jo atbalstīja savu bijušo kolēģi Timnitu Gebru, kura ētiskās bažas par AI saskārās ar Google AI vadību.)

Gato nekādā ziņā nav unikāls ar savu vispārināšanas tendenci. Tā ir daļa no plašās vispārināšanas tendences un lielākiem modeļiem, kas izmanto daudz zirgspēku. Pagājušajā vasarā pasaule pirmo reizi izbaudīja Google virzienu šajā virzienā, izmantojot Google neironu tīklu “Perceiver”, kas apvienoja teksta transformatora uzdevumus ar attēliem, skaņu un LiDAR telpiskajām koordinātām.

Arī: Google supermodelis: DeepMind Perceiver ir solis ceļā uz AI mašīnu, kas varētu apstrādāt jebko un visu

Tā vienaudžu vidū ir PaLM, Pathways Language Model, šogad ieviesa Google zinātnieki, 540 miljardu parametru modelis, kas izmanto jaunu tehnoloģiju tūkstošiem mikroshēmu koordinēšanai, pazīstams kā Pathways, ko arī izgudroja Google. Neironu tīkls, ko janvārī izlaida kompānija Meta, ar nosaukumu “data2vec”, izmanto transformatorus attēlu datiem, runas audio viļņu formām un teksta valodas attēlojumiem vienā.

Šķiet, ka Gato jaunums ir nodoms izmantot AI, kas tiek izmantots uzdevumiem, kas nav saistīti ar robotiem, un virzīt to robotikas jomā.

Gato veidotāji, atzīmējot Pathways sasniegumus un citas vispārīgas pieejas, redz maksimālu AI sasniegumu, kas var darboties reālajā pasaulē ar jebkāda veida uzdevumiem.

"Turpmākajā darbā būtu jāapsver, kā apvienot šīs teksta iespējas vienā pilnībā vispārīgā aģentā, kas var darboties arī reāllaikā reālajā pasaulē, dažādās vidēs un iemiesojumos."

Jūs varētu uzskatīt, ka Gato ir svarīgs solis ceļā uz AI sarežģītākās problēmas, robotikas, risināšanu.