Meta “data2vec” ir nākamais solis ceļā uz vienu neironu tīklu, lai pārvaldītu tos visus

Sacensības turpinās, lai izveidotu vienu neironu tīklu, kas var apstrādāt vairāku veidu datus, jēdzienu par vispārīgāku mākslīgo intelektu, kas nešķiro datu veidus, bet tā vietā var tos visus sadalīt vienā pamatstruktūrā.

Multimodalitātes žanrs, kā sauc šos neironu tīklus, ir vērojams aktivitāšu uzplūdums, kurā dažādi dati, piemēram, attēls, teksts un runas audio, tiek nodoti caur vienu un to pašu algoritmu, lai iegūtu rezultātu dažādos testos, piemēram, attēla atpazīšana, dabiskās valodas izpratne vai runas noteikšana.

Un šie divpusīgie tīkli uzkrāj punktus AI etalonpārbaudēs. Jaunākais sasniegums ir tā sauktais “data2vec”, ko izstrādājuši Facebook, Instagram un WhatsApp mātes uzņēmuma Meta AI nodaļas pētnieki.

Kā raksta Meta zinātnieki Aleksejs Baevskis, Wei-Ning Hsu, Qiantong Xu, Arun Babu, Jiatao Gu un Michael Auli, mērķis ir tuvoties kaut kam vairāk kā vispārējām mācīšanās spējām, kuras, šķiet, ietver cilvēka prāts.

"Lai gan šķiet, ka cilvēki mācās līdzīgā veidā neatkarīgi no tā, kā viņi iegūst informāciju, piemēram, vai viņi izmanto redzi vai skaņu," raksta autori. emuāra ziņā, “pašlaik pastāv lielas atšķirības, kā” neironu tīkli apstrādā dažāda veida datus, piemēram, attēlus, runu, tekstu un citus veidus.

"Šīs pieejas pamatideja," viņi apgalvo data2vec, "ir mācīties vispārīgāk: AI jāspēj iemācīties veikt daudzus dažādus uzdevumus, tostarp tos, kas ir pilnīgi nepazīstami."

Meta izpilddirektors Marks Cukerbergs piedāvāja citātu par darbu, saistot to ar nākotnes Metaverse:

Aizraujošs sasniegums: Meta AI pētījumi izveidoja sistēmu, kas mācās no runas, redzes un teksta, neizmantojot marķētus apmācību datus. Cilvēki piedzīvo pasauli, izmantojot redzes, skaņas un vārdu kombināciju, un šādas sistēmas kādu dienu varētu saprast pasauli tā, kā mēs to darām. Tas viss galu galā tiks iebūvēts AR brillēs ar AI palīgu, lai, piemēram, varētu palīdzēt pagatavot vakariņas, pamanot, ja izlaižat kādu sastāvdaļu, pamudināt samazināt siltumu vai veikt sarežģītākus uzdevumus.

Nosaukums data2vec ir valodas “iegulšanas” programmas nosaukuma spēle. izstrādāts Google 2013. gadā sauc par “word2vec”. Šī programma paredzēja, kā vārdi saplūst kopā, un tāpēc word2vec tas reprezentē neironu tīklu, kas paredzēts noteikta veida datiem, šajā gadījumā tekstam.

Arī: Lūdzu, atveriet podnieka durvis, HAL: Meta AI simulē lasīšanu no lūpām

Tomēr data2vec gadījumā Baevskis un kolēģi izmanto tā dēvētā transformatora standarta versiju, ko izstrādājis Ashish Vaswani un kolēģi. Google 2017. gadā un paplašinot to, lai to varētu izmantot vairākiem datu tipiem.

Transformatora neironu tīkls sākotnēji tika izstrādāts valodu uzdevumiem, taču kopš tā laika tas ir plaši pielāgots daudzu veidu datiem. Baevskis et al. parāda, ka transformatoru var izmantot, lai apstrādātu dažāda veida datus, tos nemainot, un apmācītais neironu tīkls, kura rezultātā var veikt vairākus dažādus uzdevumus.

Oficiālajā dokumentā "data2vec: vispārējs satvars pašpārraudzītai runas, redzes un valodas apguvei”, Baevski et al., apmāca transformatoru attēla datiem, runas audio viļņu formām un teksta valodas attēlojumam.

Data2vec ir “pirmais augstas veiktspējas pašpārraudzītais algoritms, kas darbojas vairākām modalitātēm, proti, runai, redzei un tekstam,” emuāra ierakstā raksta Baevskis un komanda.

Ļoti vispārīgs transformators kļūst par tā saukto iepriekšēju apmācību, ko pēc tam var izmantot konkrētiem neironu tīkliem, lai veiktu konkrētus uzdevumus. Piemēram, autori izmanto data2vec kā iepriekšēju apmācību, lai aprīkotu tā saukto “ViT”, “redzes transformatoru”, neironu tīklu, kas īpaši paredzēts redzes uzdevumiem. tika ieviests pagājušajā gadā autors Aleksejs Dosovickis un Google kolēģi.

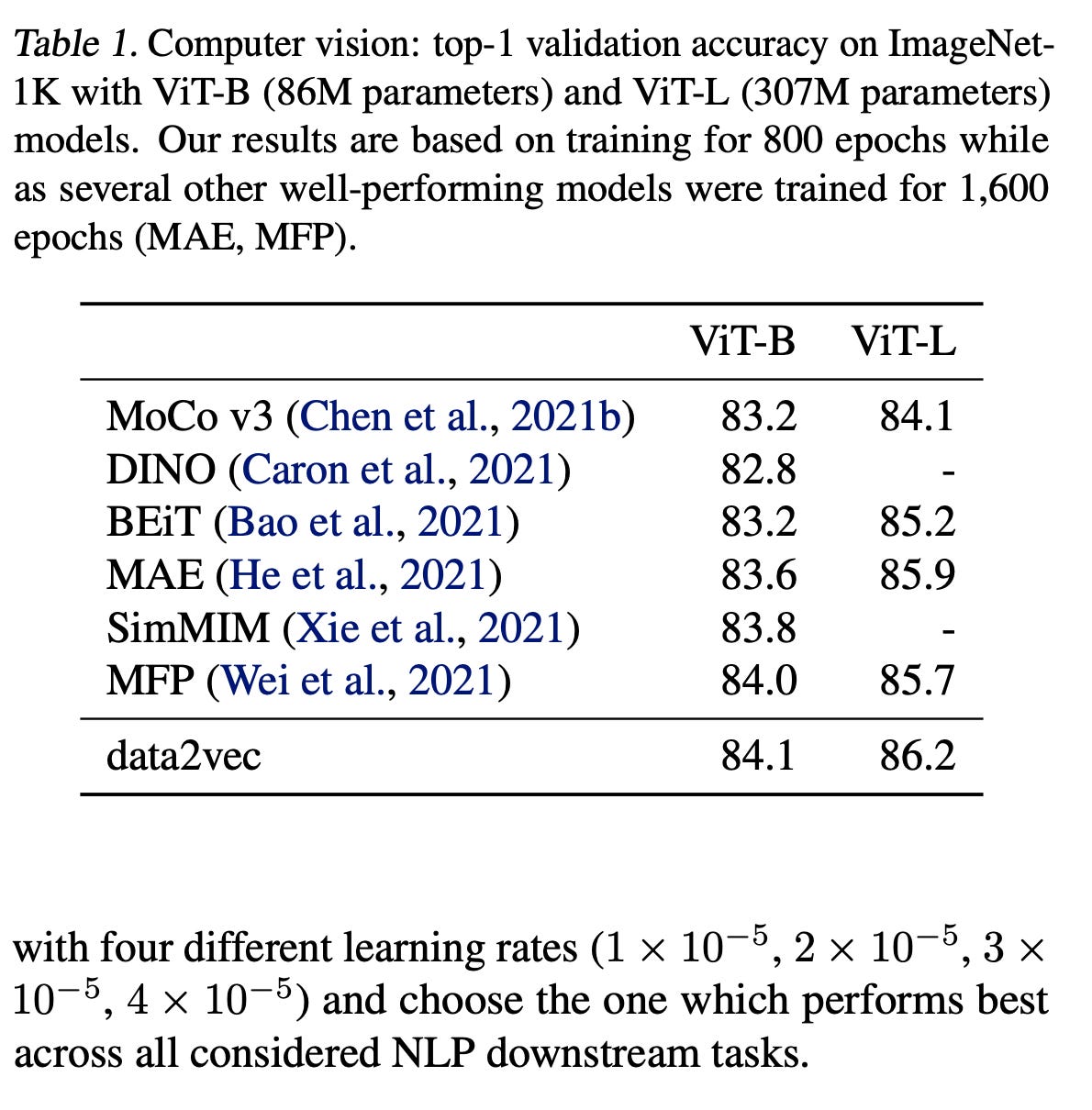

Meta parāda labākos rezultātus godājamajā ImageNet attēlu atpazīšanas konkursā.

Meta 2022

Ja tos izmanto ViT, lai mēģinātu atrisināt standarta ImageNet attēlu atpazīšanas testu, to rezultāti atrodas komplekta augšdaļā ar 84.1 % precizitāti, kas ir labāka nekā 83.2 % rezultātu, ko saņēma Microsoft komanda, kas iepriekš apmācīja. ViT, kuru vada Hangbo Bao, pagājušajā gadā.

Un tas pats data2vec Transformer izvada rezultātus, kas ir vismodernākie runas atpazīšanas jomā un ir konkurētspējīgi, ja ne vislabākie, dabiskās valodas apguvei:

Eksperimentālie rezultāti liecina, ka data2vec ir efektīvs visās trīs modalitātēs, radot jaunus sasniegumus ViT-B un ViT-L programmā ImageNet-1K, uzlabojot iepriekšējo darbu runas apstrādē runas atpazīšanas jomā un veicot līdzvērtīgu darbību RoBERTa. par GLUE dabiskās valodas izpratnes etalonu.

Būtība ir tāda, ka tas notiek bez jebkādām neironu tīkla izmaiņām, lai tas būtu saistīts ar attēliem, un tas pats attiecas uz runu un tekstu. Tā vietā katrs ievades veids nonāk tajā pašā tīklā un veic vienu un to pašu vispārīgo uzdevumu. Šis uzdevums ir tas pats uzdevums, ko vienmēr izmanto transformatoru tīkli, kas pazīstams kā "maskētā prognozēšana".

Arī: Google supermodelis: DeepMind Perceiver ir solis ceļā uz AI mašīnu, kas varētu apstrādāt jebko un visu

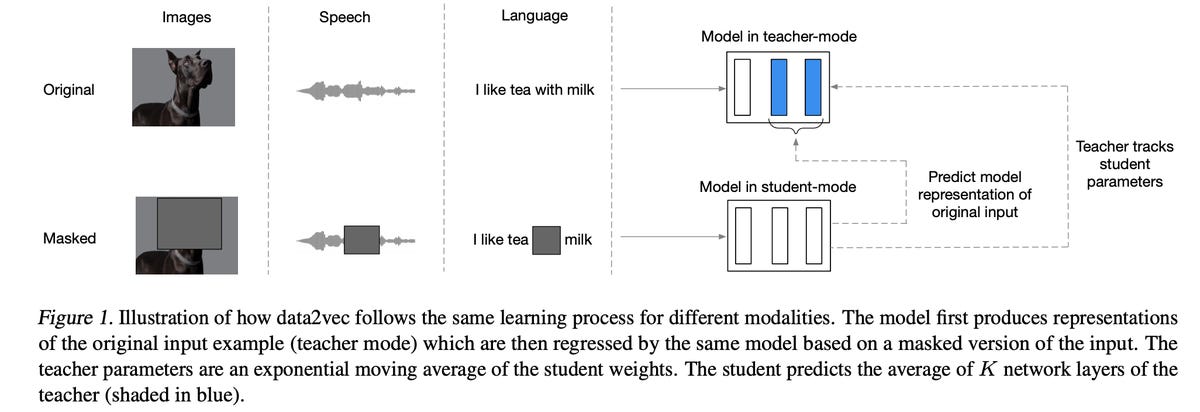

Tomēr veids, kā data2vec veic maskētu prognozēšanu, ir pazīstama kā “pašuzraudzīta” mācīšanās. Pašuzraudzītā vidē neironu tīkls tiek apmācīts vai attīstīts, izejot vairākus posmus.

Pirmkārt, tīkls konstruē kopīgās datu ievades varbūtības attēlojumu neatkarīgi no tā, vai tie ir attēli, runa vai teksts. Pēc tam otrajā tīkla versijā daži no šiem ievades datu vienumiem ir “aizmaskēti”, atstāti neatklāti. Tam ir jārekonstruē kopējā varbūtība, ko izveidoja pirmā tīkla versija, kas liek tai izveidot arvien labākus datu attēlojumus, būtībā aizpildot tukšās vietas.

Data2vec pieejas pārskats.

Meta 2022

Divus tīklus, vienu ar pilnu kopīgās varbūtības modeli un vienu ar nepilnīgo versiju, ko tas mēģina pabeigt, pietiekami saprātīgi sauc par "skolotāju" un "skolēnu". Studentu tīkls mēģina attīstīt savu datu izjūtu, ja vēlaties, rekonstruējot to, ko Skolotājs jau bija sasniedzis.

jūs varat skatiet modeļu kodu vietnē Github.

Kā neironu tīkls darbojas skolotājam un skolēnam trīs ļoti dažādu veidu datiem? Galvenais ir tas, ka kopīgās varbūtības “mērķis” visos trīs datu gadījumos nav konkrēts izvaddatu tips, kā tas ir Transformatora versijās noteiktam datu tipam, piemēram, Google BERT vai OpenAI GPT-3. .

Drīzāk data2vec satver dažus neironu tīkla slāņus, kas ir iekšā neironu tīkls, kaut kur pa vidu, kas attēlo datus, pirms tie tiek izveidoti kā galīgā izvade.

Kā raksta autori: “Viena no galvenajām mūsu metodes atšķirībām […], izņemot maskētas prognozēšanas veikšanu, ir tādu mērķu izmantošana, kuru pamatā ir vairāku slāņu vidējā noteikšana no skolotāju tīkla.” Konkrēti, "mēs regresējam vairākus neironu tīkla slāņa attēlojumus, nevis tikai augšējo slāni", lai "data2vec prognozētu ievades datu latentos attēlojumus".

Viņi piebilst: "Mēs parasti izmantojam FFN [pārplūdes tīkla] izvadi pirms pēdējā atlikušā savienojuma katrā blokā kā mērķi", kur "bloks" ir neironu tīkla slāņa transformatora ekvivalents.

Lieta ir tāda, ka katrs ievadītais datu tips kļūst par vienu un to pašu izaicinājumu Studentu tīklam, lai rekonstruētu kaut ko skolotāja izveidotajā neironu tīklā.

Šī vidējā aprēķināšana atšķiras no citām nesenajām pieejām One Network To Crunch All Data izveidei. Piemēram, pagājušajā vasarā Google DeepMind vienība piedāvāja to, ko tā sauc par “Perceiver”, savu Transformer multimodālo versiju. Perceiver neironu tīkla apmācība ir standarta process, lai radītu izvadi, kas ir atbilde uz iezīmētu, uzraudzītu uzdevumu, piemēram, ImageNet. Pašuzraudzītā pieejā data2vec neizmanto šīs etiķetes, tas tikai mēģina rekonstruēt tīkla iekšējo datu attēlojumu.

Vēl vērienīgāki centieni slēpjas spārnos. Džefs Dīns, Google AI pasākumu vadītājs, oktobrī ķircināja par “Pathways”, ko Dīns uzskata par “nākamās paaudzes AI arhitektūra” multimodālai datu apstrādei.

Ņemiet vērā, ka data2vec ļoti vispārīgā pieeja vienam neironu tīklam vairākām modalitātēm joprojām satur daudz informācijas par dažādiem datu tipiem. Attēls, runa un teksts tiek sagatavoti, iepriekš apstrādājot datus. Tādā veidā tīkla multimodālais aspekts joprojām balstās uz norādēm par datiem, ko komanda dēvē par "maziem modalitātes specifiskiem ievades kodētājiem".

Arī: Google iepazīstina ar “Pathways” — nākamās paaudzes AI, ko var apmācīt vairāku uzdevumu veikšanai

"Neskatoties uz vienoto mācību režīmu, mēs joprojām izmantojam modalitātei raksturīgus funkciju ekstraktorus un maskēšanas stratēģijas," viņi skaidro.

Tādējādi mēs vēl neesam nonākuši pasaulē, kurā tiek apmācīts neironu tīkls bez jebkādas jēgas no ievades datu veidiem. Mēs arī neesam tajā brīdī, kad neironu tīkls var izveidot vienu reprezentāciju, kas apvieno visus dažādos datu tipus, lai neironu tīkls apgūtu lietas kombinācijā.

Šis fakts skaidri izriet no savstarpējās apmaiņas ZDNet un autori. ZDNet sazinājās ar Baevski un komandu un jautāja: "Vai latentie attēlojumi, kas kalpo kā mērķi, ir visu trīs modalitātes kombinēts kodējums jebkurā laika posmā, vai arī tie parasti ir tikai viena no modalitātēm?"

Baevskis un komanda atbild, ka tas ir pēdējais gadījums, un viņu reply interesanti gari citēt:

Latentie mainīgie nav kombinētais kodējums trim modalitātēm. Mēs apmācām atsevišķus modeļus katrai modalitātei, taču process, kurā modeļi mācās, ir identisks. Šis ir mūsu projekta galvenais jauninājums, jo iepriekš bija lielas atšķirības modeļu apmācībā dažādās modalitātēs. Neirozinātnieki arī uzskata, ka cilvēki līdzīgā veidā mācās par skaņām un vizuālo pasauli. Mūsu projekts parāda, ka pašpārbaudīta mācīšanās var darboties vienādi ar dažādām metodēm.

Ņemot vērā data2vec modalitātei raksturīgos ierobežojumus, neironu tīkls, kas patiešām varētu būt Viens tīkls, lai pārvaldītu tos visus joprojām ir nākotnes tehnoloģija.