Meta 'data2vec' je ďalším krokom k jednej neurónovej sieti, ktorá im bude vládnuť všetkým

Preteky sú vo vytvorení jednej neurónovej siete, ktorá dokáže spracovať viacero druhov údajov, predstavu všeobecnejšej umelej inteligencie, ktorá nerozlišuje medzi typmi údajov, ale namiesto toho ich dokáže všetky rozdrviť v rámci rovnakej základnej štruktúry.

Žáner multimodality, ako sa tieto neurónové siete nazývajú, je svedkom záplavy aktivít, pri ktorých sa rôzne údaje, ako napríklad obraz, text a zvuk reči, prechádzajú cez rovnaký algoritmus, aby sa získali skóre v rôznych testoch, ako napr. rozpoznávanie obrazu, porozumenie prirodzenému jazyku či detekcia reči.

A tieto obojručné siete dosahujú skóre v benchmarkových testoch AI. Najnovším úspechom je to, čo sa nazýva „data2vec“, vyvinuté výskumníkmi z divízie AI spoločnosti Meta, ktorá je rodičom Facebooku, Instagramu a WhatsApp.

Ide o to, ako píšu vedci z Meta, Alexei Baevski, Wei-Ning Hsu, Qiantong Xu, Arun Babu, Jiatao Gu a Michael Auli, priblížiť sa k niečomu viac podobnému všeobecnej schopnosti učiť sa, ktorú akoby zahŕňala ľudská myseľ.

„Zatiaľ čo sa zdá, že ľudia sa učia podobným spôsobom bez ohľadu na to, ako získavajú informácie – či už napríklad používajú zrak alebo zvuk,“ píšu autori v blogu, „v súčasnosti existujú veľké rozdiely v spôsobe, akým“ neurónové siete spracúvajú rôzne typy údajov, ako sú obrázky, reč, text, „a iné modality“.

„Základnou myšlienkou tohto prístupu,“ vyhlasujú z data2vec, „je učiť sa všeobecnejšie: AI by sa mala vedieť naučiť robiť mnoho rôznych úloh vrátane tých, ktoré sú úplne neznáme.“

Generálny riaditeľ spoločnosti Meta, Mark Zuckerberg, ponúkol citát o práci a spojil ju s budúcim Metaverse:

Vzrušujúci prelom: Výskum Meta AI vytvoril systém, ktorý sa učí z reči, videnia a textu bez potreby označených tréningových údajov. Ľudia zažívajú svet prostredníctvom kombinácie zraku, zvuku a slov a systémy ako tento by mohli jedného dňa chápať svet tak, ako my. To všetko bude nakoniec zabudované do okuliarov AR s asistentom AI, takže vám napríklad môže pomôcť pri varení večere, všímať si, či vám chýba ingrediencia, vyzvať vás, aby ste stíšili teplo, alebo zložitejšie úlohy.

Názov data2vec je hra s názvom programu na „vkladanie“ jazyka vyvinuté v spoločnosti Google v roku 2013 s názvom „word2vec“. Tento program predpovedal, ako sa slová zhlukujú, a tak word2vec predstavuje neurónovú sieť navrhnutú pre špecifický typ údajov, v tomto prípade text.

Tiež: Otvorte, prosím, dvierka priehradky, HAL: Umelá inteligencia Meta simuluje čítanie z pier

V prípade data2vec však Baevski a kolegovia berú štandardnú verziu toho, čo sa nazýva Transformer, vyvinutú Ashishom Vaswanim a kolegami. v spoločnosti Google v roku 2017 a jeho rozšírenie na použitie pre viacero typov údajov.

Neurónová sieť Transformer bola pôvodne vyvinutá pre jazykové úlohy, ale v priebehu rokov bola široko prispôsobená pre mnoho druhov údajov. Baevski a kol. ukazujú, že Transformer možno použiť na spracovanie viacerých druhov údajov bez toho, aby boli zmenené, a trénovaná neurónová sieť, ktorá je výsledkom toho, môže vykonávať viacero rôznych úloh.

Vo formálnom dokumente „data2vec: Všeobecný rámec pre samokontrolované učenie sa reči, videnia a jazykaBaevski a kol., trénujú Transformer pre obrazové dáta, zvukové vlny reči a reprezentácie textového jazyka.

Data2vec je „prvý vysokovýkonný algoritmus s vlastným dohľadom, ktorý funguje pre viacero spôsobov, menovite reč, víziu a text,“ píšu Baevski a tím v blogovom príspevku.

Veľmi všeobecný Transformer sa stáva tým, čo sa nazýva predbežné školenie, ktoré sa potom môže aplikovať na špecifické neurónové siete, aby bolo možné vykonávať špecifické úlohy. Autori napríklad používajú data2vec ako predbežné školenie na vybavenie toho, čo sa nazýva „ViT“, „Vision Transformer“, neurónová sieť špeciálne navrhnutá pre úlohy zraku, ktoré bola predstavená minulý rok od Alexeyho Dosovitského a kolegov z Google.

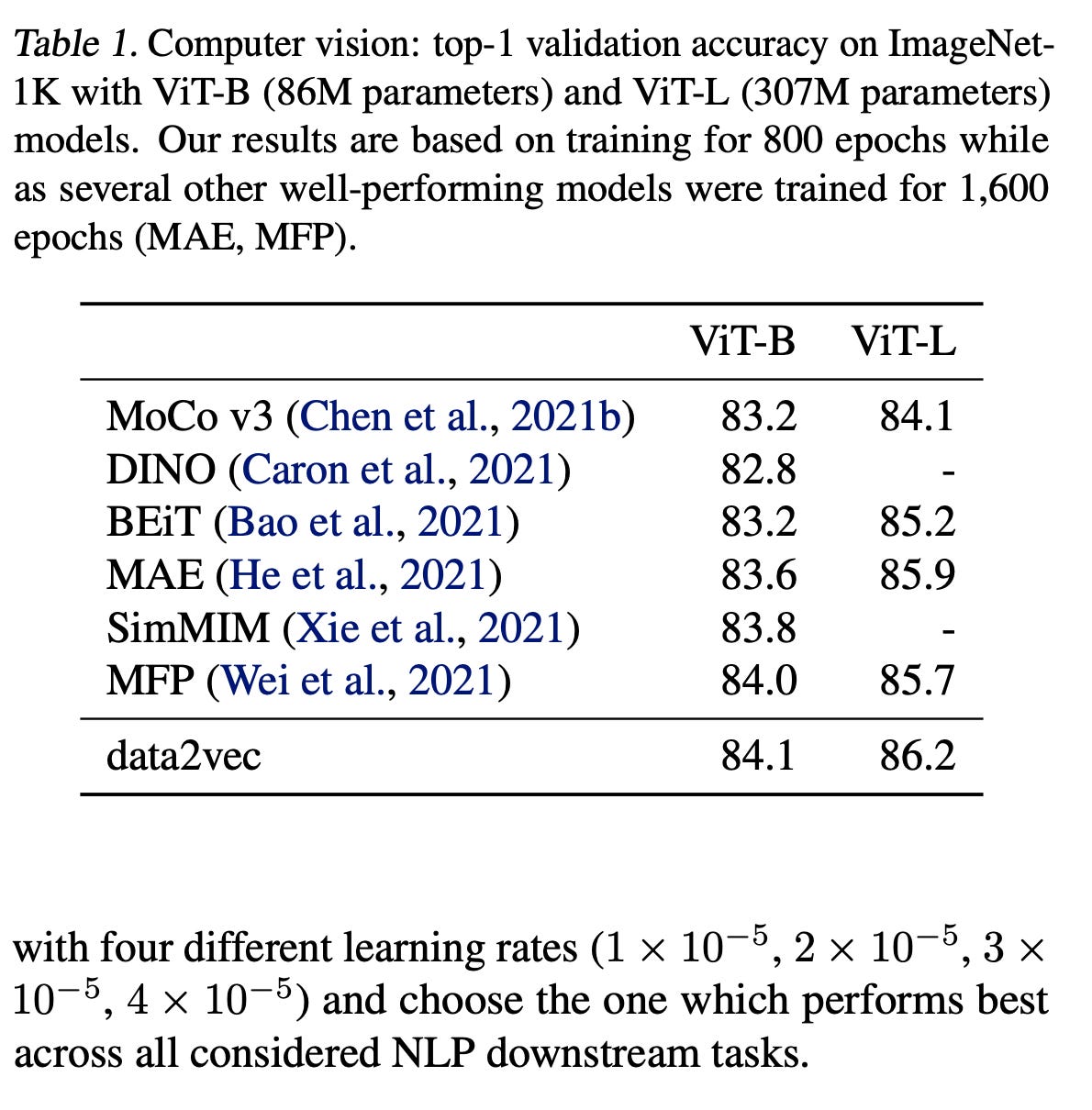

Meta zobrazuje najvyššie skóre v úctyhodnej súťaži ImageNet v rozpoznávaní obrázkov.

Meta 2022

Pri použití na ViT pri pokuse vyriešiť štandardný ImageNet test rozpoznávania obrázkov sa ich výsledky dostanú na vrchol s presnosťou 84.1 %, čo je lepšie ako skóre 83.2 %, ktoré získal tím spoločnosti Microsoft, ktorý predškolil ViT, ktorý vedie Hangbo Bao, vlani.

A rovnaký data2vec Transformer poskytuje výsledky, ktoré sú najmodernejším pre rozpoznávanie reči a ktoré sú konkurencieschopné, ak nie najlepšie, pre učenie sa prirodzeného jazyka:

Experimentálne výsledky ukazujú, že data2vec je účinný vo všetkých troch modalitách, čím nastavuje nový stav techniky pre ViT-B a ViT-L na ImageNet-1K, čím sa zlepšuje v porovnaní s najlepšou predchádzajúcou prácou v spracovaní reči pri rozpoznávaní reči a má rovnakú výkonnosť ako RoBERTa. na benchmarku porozumenia prirodzenému jazyku GLUE.

Jadrom je, že sa to deje bez akejkoľvek úpravy neurónovej siete, aby sa týkala obrázkov, a to isté platí pre reč a text. Namiesto toho každý typ vstupu ide do rovnakej siete a dokončuje rovnakú veľmi všeobecnú úlohu. Táto úloha je rovnaká úloha, ktorú siete Transformer vždy používajú, známa ako „maskovaná predpoveď“.

Tiež: Supermodelka Google: DeepMind Perceiver je krokom na ceste k stroju AI, ktorý dokáže spracovať čokoľvek a všetko

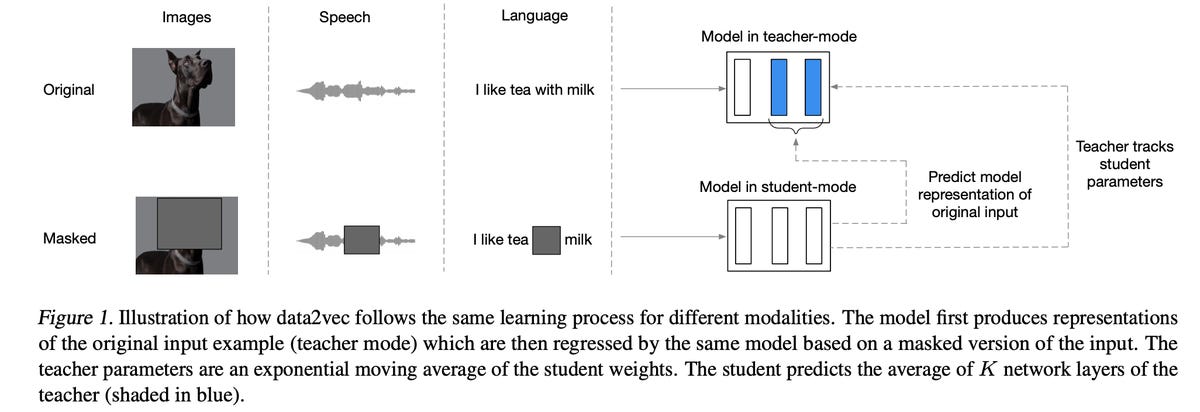

Spôsob, akým data2vec vykonáva maskovanú predikciu, je však prístup známy ako „učenie s vlastným dohľadom“. V prostredí s vlastným dohľadom sa neurónová sieť trénuje alebo rozvíja tak, že musí prejsť viacerými štádiami.

Po prvé, sieť vytvorí reprezentáciu spoločnej pravdepodobnosti vstupu dát, či už ide o obrázky, reč alebo text. Potom má druhá verzia siete niektoré z týchto vstupných dátových položiek „zamaskované“, ktoré zostali neodhalené. Musí rekonštruovať spoločnú pravdepodobnosť, ktorú vytvorila prvá verzia siete, čo ho núti vytvárať stále lepšie reprezentácie údajov v podstate vypĺňaním prázdnych miest.

Prehľad prístupu data2vec.

Meta 2022

Dve siete, jedna s úplným vzorom spoločnej pravdepodobnosti a jedna s neúplnou verziou, ktorú sa snaží dokončiť, sa rozumne nazývajú „Učiteľ“ a „Študent“. Študentská sieť sa snaží rozvíjať svoj zmysel pre dáta, ak chcete, rekonštrukciou toho, čo už Učiteľ dosiahol.

Môžete pozrite si kód pre modely na Github.

Ako funguje neurónová sieť Učiteľ a Študent pre tri veľmi odlišné typy údajov? Kľúčom je, že „cieľ“ spoločnej pravdepodobnosti vo všetkých troch prípadoch údajov nie je špecifický typ výstupných údajov, ako je to v prípade verzií Transformera pre konkrétny typ údajov, ako je napríklad BERT od Googlu alebo GPT-3 od OpenAI. .

Data2vec skôr zachytáva niekoľko vrstiev neurónovej siete, ktoré sú vo vnútri neurónová sieť, niekde v strede, ktorá reprezentuje dáta predtým, než sa vytvoria ako konečný výstup.

Ako píšu autori: „Jedným z hlavných rozdielov našej metódy […] okrem vykonávania maskovanej predpovede je použitie cieľov, ktoré sú založené na spriemerovaní viacerých vrstiev zo siete učiteľov.“ Konkrétne „regresujeme viaceré reprezentácie vrstvy neurónovej siete namiesto iba vrchnej vrstvy“, takže „data2vec predpovedá latentné reprezentácie vstupných údajov“.

Dodávajú: „Vo všeobecnosti používame ako cieľ výstup FFN [doprednej siete] pred posledným zvyškovým pripojením v každom bloku,“ kde „blok“ je transformátorový ekvivalent vrstvy neurónovej siete.

Ide o to, že každý dátový typ, ktorý vstúpi, sa stane rovnakou výzvou pre študentskú sieť rekonštruovať niečo vo vnútri neurónovej siete, ktorú vytvoril Učiteľ.

Toto spriemerovanie sa líši od ostatných nedávnych prístupov k budovaniu jednej siete na stlačenie všetkých údajov. Napríklad minulé leto jednotka DeepMind spoločnosti Google ponúkla to, čo nazýva „Perceiver“, svoju vlastnú multimodálnu verziu Transformera. Tréning neurónovej siete Perceiver je štandardnejším procesom produkcie výstupu, ktorý je odpoveďou na označenú úlohu pod dohľadom, ako je ImageNet. V samoobslužnom prístupe data2vec nepoužíva tieto označenia, len sa pokúša rekonštruovať vnútornú reprezentáciu údajov v sieti.

Ešte ambicióznejšie úsilie spočíva v krídlach. Jeff Dean, vedúci úsilia spoločnosti Google v oblasti AI, v októbri žartoval o „cestách“, čo Dean tvrdí, že „architektúra AI novej generácie” pre multimodálne spracovanie údajov.

Nezabúdajte, že veľmi všeobecný prístup data2vec k jednej neurónovej sieti pre viacero modalít má stále veľa informácií o rôznych typoch údajov. Obraz, reč a text sú pripravené predbežným spracovaním údajov. Týmto spôsobom sa multimodálny aspekt siete stále spolieha na informácie o údajoch, ktoré tím označuje ako „malé vstupné kódovače špecifické pre modalitu“.

Tiež: Google odhaľuje „Cesty“, umelú inteligenciu novej generácie, ktorú možno trénovať na multitasking

„Napriek jednotnému vzdelávaciemu režimu stále používame extraktory funkcií špecifických pre modality a maskovacie stratégie,“ vysvetľujú.

Preto ešte nie sme vo svete, kde by sa neurónová sieť trénovala bez akéhokoľvek zmyslu pre typy vstupných údajov. Tiež nie sme v bode v čase, keď by neurónová sieť mohla vytvoriť jednu reprezentáciu, ktorá kombinuje všetky rôzne typy údajov, takže neurónová sieť sa učí veci v kombinácii.

Táto skutočnosť je zrejmá z výmeny názorov medzi nimi ZDNet a autori. ZDNet oslovil Baevského a tím a spýtal sa: „Sú latentné reprezentácie, ktoré slúžia ako ciele, kombinovaným kódovaním všetkých troch modalít v akomkoľvek danom časovom kroku, alebo sú zvyčajne len jednou z modalít?

Baevski a tím odpovedajú, že ide o druhý prípad a ich reply je zaujímavé dlho citovať:

Latentné premenné nie sú kombinovaným kódovaním pre tieto tri modality. Trénujeme samostatné modely pre každú modalitu, ale proces, ktorým sa modely učia, je identický. Toto je hlavná inovácia nášho projektu, pretože predtým existovali veľké rozdiely v tom, ako sú modely trénované v rôznych modalitách. Neurovedci tiež veria, že ľudia sa podobným spôsobom učia o zvukoch a vizuálnom svete. Náš projekt ukazuje, že samokontrolované učenie môže tiež fungovať rovnakým spôsobom pre rôzne modality.

Vzhľadom na obmedzenia špecifické pre modalitu data2vec by to mohla byť neurónová sieť Jedna sieť, ktorá im bude vládnuť všetkým zostáva technológiou budúcnosti.