Meta'nın 'data2vec'i, Hepsine Hükmedecek Tek Sinir Ağı'na doğru bir sonraki adımdır

Birden fazla veri türünü işleyebilen tek bir sinir ağı oluşturma yarışı, veri türleri hakkında ayrım yapmayan, bunun yerine hepsini aynı temel yapı içinde parçalayabilen daha genel bir yapay zeka kavramı.

Bu sinir ağları olarak adlandırılan çok modalite türü, görüntü, metin ve konuşma sesi gibi farklı verilerin aynı algoritmadan geçirilerek aşağıdakiler gibi farklı testlerde bir puan elde edildiği bir etkinlik telaşı görüyor. görüntü tanıma, doğal dil anlama veya konuşma algılama.

Ve bu çok yönlü ağlar, AI'nın kıyaslama testlerinde puanlar alıyor. En son başarı, Facebook, Instagram ve WhatsApp'ın ebeveyni Meta'nın AI bölümündeki araştırmacılar tarafından geliştirilen "data2vec" olarak adlandırılan şeydir.

Meta'nın bilim adamları Alexei Baevski, Wei-Ning Hsu, Qiantong Xu, Arun Babu, Jiatao Gu ve Michael Auli'nin yazdığı gibi, mesele, insan zihninin kapsadığı görünen genel öğrenme yeteneğine daha çok benzer bir şeye yaklaşmak.

Yazarlar, "İnsanlar bilgiyi nasıl edindiklerine bakılmaksızın benzer bir şekilde öğreniyor gibi görünse de - örneğin görüntü veya ses kullanıp kullanmadıklarına bakmaksızın" bir blog yazısı, "şu anda büyük farklılıklar var", sinir ağlarının görüntü, konuşma, metin, "ve diğer modaliteler" gibi farklı veri türlerini işlemesi.

data2vec'in açıklamasına göre "Bu yaklaşımın temel fikri, daha genel olarak öğrenmektir: AI, tamamen yabancı olanlar da dahil olmak üzere birçok farklı görevi yapmayı öğrenebilmelidir."

Meta'nın CEO'su Mark Zuckerberg, çalışma hakkında gelecekteki bir Metaverse'e bağlayarak bir alıntı yaptı:

Heyecan verici buluş: Meta AI araştırması, etiketli eğitim verilerine ihtiyaç duymadan konuşma, görüntü ve metinden öğrenen bir sistem oluşturdu. İnsanlar dünyayı görüntü, ses ve kelimelerin bir kombinasyonu aracılığıyla deneyimliyorlar ve bunun gibi sistemler bir gün dünyayı bizim yaptığımız gibi anlayabilir. Bunların hepsi sonunda bir AI asistanı ile AR gözlüklerine entegre edilecek, böylece örneğin akşam yemeği pişirmenize yardımcı olabilir, bir malzemeyi kaçırıp kaçırmadığınızı fark ederek, ısıyı düşürmenizi veya daha karmaşık görevleri yapmanızı isteyebilir.

data2vec adı, "gömme" dili için bir programın adı üzerinde oynanan bir oyundur. 2013 yılında Google'da geliştirildi "word2vec" olarak adlandırılır. Bu program, kelimelerin nasıl bir araya toplandığını tahmin etti ve bu nedenle word2vec, belirli bir veri türü, bu durumda metin için tasarlanmış bir sinir ağını temsil ediyor.

Ayrıca: Pod bölmesi kapılarını açın lütfen, HAL: Meta'nın yapay zekası dudak okumayı simüle ediyor

Ancak data2vec durumunda, Baevski ve meslektaşları, Ashish Vaswani ve meslektaşları tarafından geliştirilen, Transformer olarak adlandırılan şeyin standart bir versiyonunu alıyorlar. 2017'de Google'da ve birden çok veri türü için kullanılacak şekilde genişletilmesi.

Transformer sinir ağı başlangıçta dil görevleri için geliştirildi, ancak o zamandan beri birçok veri türü için geniş çapta uyarlandı. Baevski et al. Transformer'ın değiştirilmeden birden fazla türde veriyi işlemek için kullanılabileceğini ve sonuçta ortaya çıkan eğitimli sinir ağının birden çok farklı görevi yerine getirebileceğini gösterin.

Resmi yazıda, "data2vec: Konuşma, Görme ve Dilde Kendi Kendine Denetimli Öğrenme için Genel Bir Çerçeve” Baevski ve diğerleri, Transformer'ı görüntü verileri, konuşma ses dalga biçimleri ve metin dili temsilleri için eğitir.

Baevski ve ekibi blog yazısında Data2vec'in "konuşma, görme ve metin gibi birden fazla modalite için çalışan ilk yüksek performanslı kendi kendini denetleyen algoritma" olduğunu yazıyor.

Çok genel Transformer, daha sonra belirli görevleri yerine getirmek için belirli sinir ağlarına uygulanabilen bir ön eğitim olarak adlandırılan hale gelir. Örneğin, yazarlar data2vec'i ön eğitim olarak "ViT" olarak adlandırılan, "vizyon Transformatörü", yani görme görevleri için özel olarak tasarlanmış bir sinir ağı ile donatmak için kullanırlar. geçen yıl tanıtıldı Alexey Dosovitskiy ve Google'daki meslektaşları tarafından.

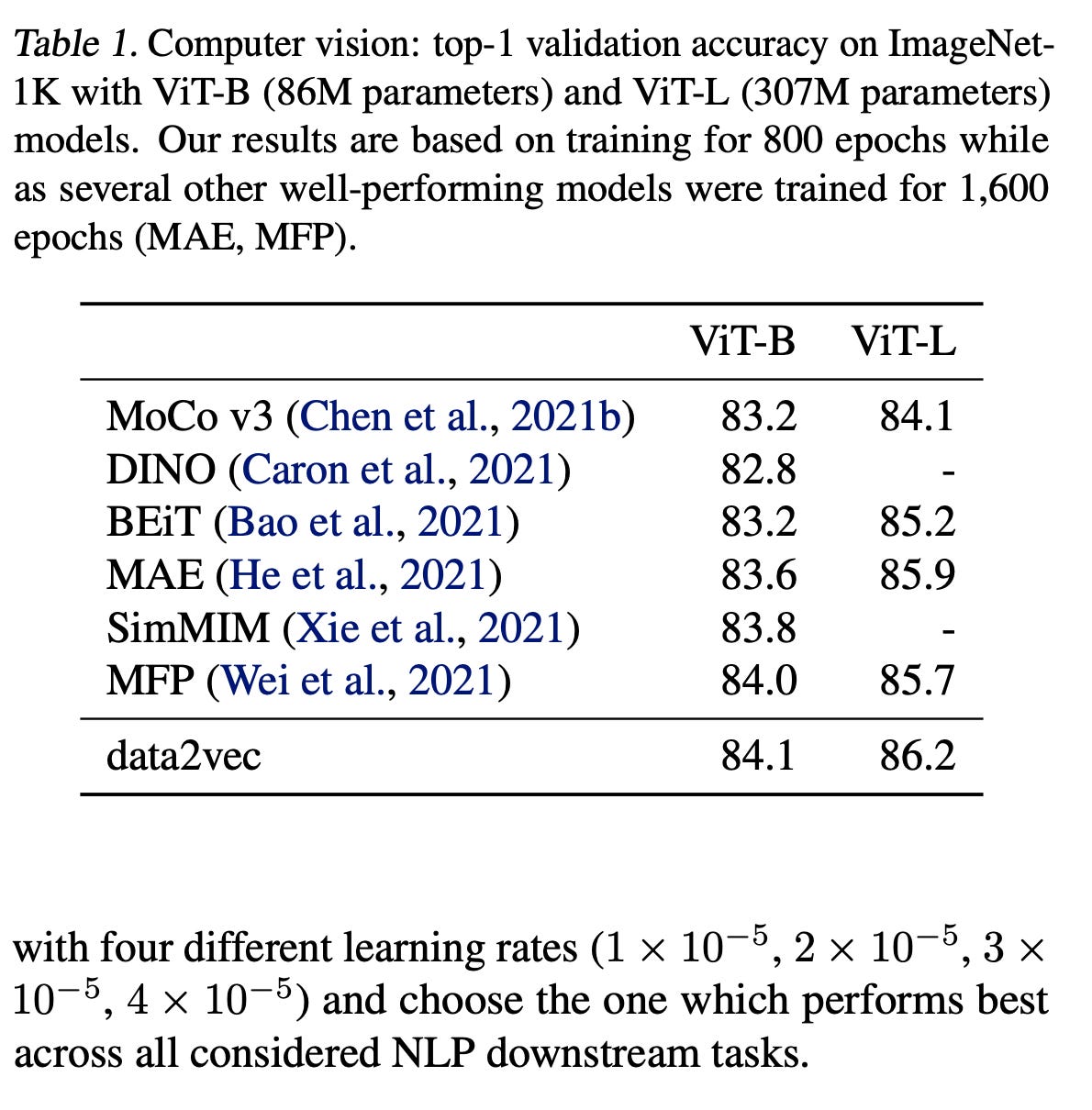

Meta, saygıdeğer ImageNet görüntü tanıma yarışması için en yüksek puanları gösterir.

Hedef 2022

ViT'de standart ImageNet görüntü tanıma testini çözmeye çalışmak için kullanıldığında, sonuçları, Microsoft'ta önceden eğitilmiş bir ekip tarafından alınan %84.1'lik puandan daha iyi, %83.2 doğrulukla paketin en üstünde gelir. Hangbo Bao liderliğindeki ViT, geçen sene.

Ve aynı data2vec Transformer, konuşma tanıma için son teknoloji ürünü ve doğal dil öğrenimi için en iyisi olmasa bile rekabetçi sonuçlar verir:

Deneysel sonuçlar data2vec'in her üç modalitede de etkili olduğunu, ImageNet-1K'da ViT-B ve ViT-L için yeni bir sanat eseri oluşturduğunu, konuşma tanıma konusunda konuşma işlemede önceki en iyi çalışmadan daha iyi olduğunu ve RoBERTa ile eşit performans gösterdiğini gösteriyor. GLUE doğal dil anlama kriterinde.

İşin püf noktası, bunun, sinir ağında herhangi bir değişiklik olmadan, görüntülerle ilgili olması ve konuşma ve metin için aynı şekilde gerçekleşmesidir. Bunun yerine, her girdi türü aynı ağa giriyor ve aynı çok genel görevi tamamlıyor. Bu görev, Transformer ağlarının her zaman kullandığı, "maskeli tahmin" olarak bilinen görevin aynısıdır.

Ayrıca: Google'ın Süper Modeli: DeepMind Perceiver, her şeyi ve her şeyi işleyebilecek bir AI makinesine giden yolda bir adımdır.

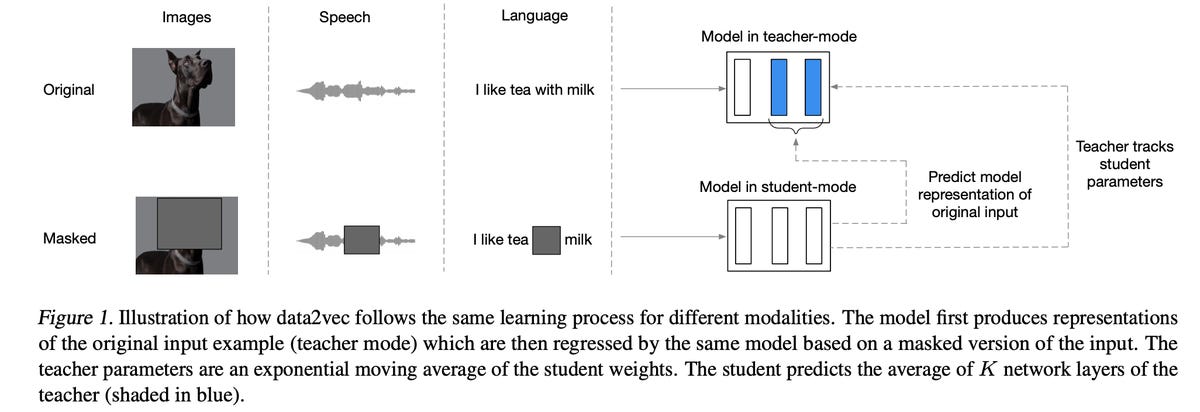

Ancak data2vec'in maskeli tahmin gerçekleştirme şekli, "kendi kendini denetleyen" öğrenme olarak bilinen bir yaklaşımdır. Kendi kendini denetleyen bir ortamda, bir sinir ağı birden fazla aşamadan geçmek zorunda kalarak eğitilir veya geliştirilir.

İlk olarak, ağ, ister görüntü, ister konuşma veya metin olsun, veri girişinin ortak olasılığının bir temsilini oluşturur. Ardından, ağın ikinci bir sürümü, "maskelenmiş" bu girdi veri öğelerinin bazılarını açıklanmadan bıraktı. Ağın ilk versiyonunun oluşturduğu ortak olasılığı yeniden yapılandırması gerekiyor, bu da onu esasen boşlukları doldurarak verilerin daha iyi ve daha iyi temsillerini yaratmaya zorluyor.

data2vec yaklaşımına genel bakış.

Hedef 2022

Ortak olasılığın tam modeline sahip olan ve tamamlamaya çalıştığı tamamlanmamış versiyonu olan iki ağ, makul bir şekilde “Öğretmen” ve “Öğrenci” olarak adlandırılır. Öğrenci ağı, isterseniz, Öğretmen'in zaten başarmış olduğunu yeniden yapılandırarak veri anlayışını geliştirmeye çalışır.

Yapabilirsin Github'daki modellerin koduna bakın.

Sinir ağı, çok farklı üç veri türü için Öğretmen ve Öğrenci performansını nasıl gerçekleştiriyor? Buradaki kilit nokta, Google'ın BERT'si veya OpenAI'nin GPT-3'ü gibi belirli bir veri türü için Transformer'ın sürümlerinde olduğu gibi, her üç veri durumunda da ortak olasılığın "hedefi"nin belirli bir çıktı veri türü olmamasıdır. .

Bunun yerine, data2vec bazı sinir ağı katmanlarını kapıyor. içeride Ortada bir yerde, nihai çıktı olarak üretilmeden önceki verileri temsil eden sinir ağı.

Yazarların yazdığı gibi, "Yöntemimizin maskeli tahmin gerçekleştirme dışındaki temel farklılıklarından biri […], öğretmen ağından birden çok katmanın ortalamasını almaya dayalı hedeflerin kullanılmasıdır." Spesifik olarak, "data2vec giriş verilerinin gizli temsillerini tahmin etmesi" için "yalnızca üst katman yerine birden çok sinir ağı katmanı temsilini geriliyoruz".

“Genellikle her bloktaki son kalan bağlantıdan önce FFN'nin [ileri beslemeli ağ] çıktısını hedef olarak kullanırız” diye eklerler, burada bir “blok” bir sinir ağı katmanının Transformer eşdeğeridir.

Mesele şu ki, giren her veri türü, Öğrenci ağı için, Öğretmen'in oluşturduğu sinir ağı içinde bir şeyi yeniden yapılandırma konusunda aynı zorluk haline gelir.

Bu ortalama, Tüm Verileri Kırmak İçin Tek Bir Ağ oluşturmaya yönelik diğer yeni yaklaşımlardan farklıdır. Örneğin, geçen yaz Google'ın DeepMind birimi, Transformer'ın kendi çok modlu versiyonunu "Algılayıcı" olarak adlandırdı. Algılayıcı sinir ağının eğitimi, ImageNet gibi etiketlenmiş, denetlenen bir göreve yanıt olan bir çıktı üretmenin daha standart sürecidir. Kendi kendini denetleyen yaklaşımda, data2vec bu etiketleri kullanmaz, sadece ağın verilerin dahili temsilini yeniden oluşturmaya çalışır.

Daha da iddialı çabalar kanatlarda yatıyor. Google'ın AI çabalarının başındaki Jeff Dean, Ekim ayında Dean'in iddia ettiği gibi "Pathways" hakkında alay etti.yeni nesil yapay zeka mimarisi” çok modlu veri işleme için.

Dikkat edin, data2vec'in çoklu modaliteler için tek bir sinir ağına yönelik çok genel yaklaşımı, farklı veri türleri hakkında hala birçok bilgiye sahiptir. Görüntü, konuşma ve metin, verilerin ön işlenmesiyle hazırlanır. Bu şekilde, ağın çok modlu yönü, ekibin "küçük modaliteye özgü giriş kodlayıcıları" olarak adlandırdığı verilerle ilgili ipuçlarına dayanır.

Ayrıca: Google, çoklu görev için eğitilebilen yeni nesil bir AI olan 'Pathways'i tanıttı

"Birleşik öğrenme rejimine rağmen, hala modaliteye özgü özellik çıkarıcıları ve maskeleme stratejilerini kullanıyoruz" diye açıklıyorlar.

Bu nedenle, henüz bir sinir ağının, girdi veri türlerinin hiçbir anlamı olmadan eğitildiği bir dünyada değiliz. Ayrıca, sinir ağının tüm farklı veri türlerini birleştiren tek bir temsil oluşturabileceği bir zamanda değiliz, böylece sinir ağı kombinasyon halinde bir şeyler öğreniyor.

Bu gerçek, aralarındaki bir değiş tokuştan açıkça anlaşılmaktadır. ZDNet ve yazarlar. ZDNet Baevski'ye ve ekibe ulaştı ve "Hedef olarak hizmet eden gizli temsiller, herhangi bir zaman adımında üç yöntemin hepsinin birleştirilmiş bir kodlaması mı, yoksa genellikle yöntemlerden sadece biri mi?" Diye sordu.

Baevski ve ekibi, bunun ikinci durumda olduğunu ve onların reply uzun uzun alıntı yapmak ilginç:

Gizli değişkenler, üç modalite için birleştirilmiş bir kodlama değildir. Her modalite için ayrı modeller eğitiyoruz, ancak modellerin öğrenme süreci aynı. Bu, projemizin ana yeniliğidir, çünkü daha önce modellerin farklı modalitelerde nasıl eğitildiği konusunda büyük farklılıklar vardı. Sinirbilimciler ayrıca insanların sesler ve görsel dünya hakkında benzer şekillerde öğrendiğine inanırlar. Projemiz, kendi kendini denetleyen öğrenmenin farklı modaliteler için de aynı şekilde çalışabileceğini gösteriyor.

data2vec'in modaliteye özgü sınırlamaları göz önüne alındığında, gerçekten olabilecek bir sinir ağı Hepsine Hükmedecek Tek Bir Ağ geleceğin teknolojisi olmaya devam ediyor.