'data2vec' של Meta הוא הצעד הבא לקראת רשת עצבית אחת שתשלוט בכולם

המירוץ ליצירת רשת עצבית אחת שיכולה לעבד סוגים מרובים של נתונים, הרעיון של בינה מלאכותית כללית יותר שאינה מפלה בין סוגי נתונים, אלא במקום זאת יכולה למחוץ את כולם באותו מבנה בסיסי.

הז'אנר של מולטי-מודאליות, כפי שמכונה רשתות עצביות אלו, הוא ראיית שפע של פעילות שבה נתונים שונים, כגון תמונה, טקסט ואודיו של דיבור, מועברים דרך אותו אלגוריתם כדי להפיק ציון במבחנים שונים כגון זיהוי תמונה, הבנת שפה טבעית או זיהוי דיבור.

והרשתות האמבידיקסטרוניות הללו צוברות ציונים במבחני הבנצ'מרק של AI. ההישג האחרון הוא מה שנקרא 'data2vec', שפותח על ידי חוקרים בחטיבת הבינה המלאכותית של Meta, האם של פייסבוק, אינסטגרם ו-WhatsApp.

הנקודה, כפי שכותבים המדענים של מטה, אלכסיי באייבסקי, ווי-נינג הסו, צ'יאנטונג שו, ארון באבו, ג'יאטאו גו ומייקל אולי, היא לגשת למשהו יותר כמו יכולת הלמידה הכללית שנראה שהמוח האנושי מקיף.

"בעוד שאנשים לומדים בצורה דומה ללא קשר לאופן שבו הם מקבלים מידע - בין אם הם משתמשים בראייה או קול, למשל", כותבים המחברים בפוסט בבלוג, "כרגע יש הבדלים גדולים בדרך" רשתות נוירונים מטפלות בסוגים שונים של נתונים כגון תמונות, דיבור, טקסט, "ושיטות אחרות".

"הרעיון המרכזי של גישה זו", הם מצהירים מ-data2vec, "הוא ללמוד באופן כללי יותר: בינה מלאכותית אמורה להיות מסוגלת ללמוד לבצע משימות רבות ושונות, כולל אלו שאינן מוכרות לחלוטין."

מנכ"ל Meta, מארק צוקרברג, הציע ציטוט לגבי העבודה, וקשר אותה ל- Metaverse עתידי:

פריצת דרך מרגשת: מחקר Meta AI בנה מערכת שלומדת מדיבור, חזון וטקסט מבלי להזדקק לנתוני אימון מסומנים. אנשים חווים את העולם באמצעות שילוב של ראייה, קול ומילים, ומערכות כמו זו יוכלו יום אחד להבין את העולם כמונו. כל זה בסופו של דבר ייכנס לתוך משקפי AR עם עוזר בינה מלאכותית, כך, למשל, זה יכול לעזור לך לבשל ארוחת ערב, לשים לב אם אתה מפספס מרכיב, להנחות אותך להנמיך את החום, או משימות מורכבות יותר.

השם data2vec הוא משחק בשם של תוכנית להטמעת שפה פותח ב-Google ב-2013 נקרא "word2vec." תוכנית זו חזתה כיצד מילים מתקבצות יחד, ולכן word2vec היא מייצגת רשת עצבית המיועדת לסוג מסוים של נתונים, במקרה זה טקסט.

גַם: פתח את דלתות המפרץ, בבקשה, HAL: ה-AI של Meta מדמה קריאת שפתיים

במקרה של data2vec, לעומת זאת, Baevski ועמיתיו לוקחים גרסה סטנדרטית של מה שנקרא Transformer, שפותחה על ידי אשיש וסואני ועמיתיו ב-Google ב-2017 והרחבתו לשימוש עבור סוגי נתונים מרובים.

הרשת העצבית של Transformer פותחה במקור עבור משימות שפה, אך היא עברה התאמה נרחבת בשנים שחלפו מאז לסוגים רבים של נתונים. Baevski et al. מראים שניתן להשתמש בשנאי לעיבוד סוגים מרובים של נתונים מבלי להשתנות, והרשת העצבית המאומנת שתוצאותיה יכולה לבצע במספר משימות שונות.

בעיתון הרשמי, "data2vec: מסגרת כללית ללמידה בפיקוח עצמי בדיבור, חזון ושפה," Baevski וחב', מאמנים את הרונאי לנתוני תמונה, צורות גל אודיו של דיבור וייצוגים של שפת טקסט.

Data2vec הוא "האלגוריתם הראשון בפיקוח עצמי בעל ביצועים גבוהים שעובד עבור מספר אופנים, כלומר דיבור, חזון וטקסט", כותבים Baevski והצוות בפוסט בבלוג.

הרונאי הכללי מאוד הופך למה שנקרא אימון מקדים שניתן להחיל אותו על רשתות עצביות ספציפיות על מנת לבצע משימות ספציפיות. לדוגמה, המחברים משתמשים ב-data2vec כהכשרה מוקדמת כדי לצייד את מה שנקרא "ViT", "שנאי הראייה", רשת עצבית שתוכננה במיוחד עבור משימות ראייה הוצג בשנה שעברה מאת Alexey Dosovitskiy ועמיתיו בגוגל.

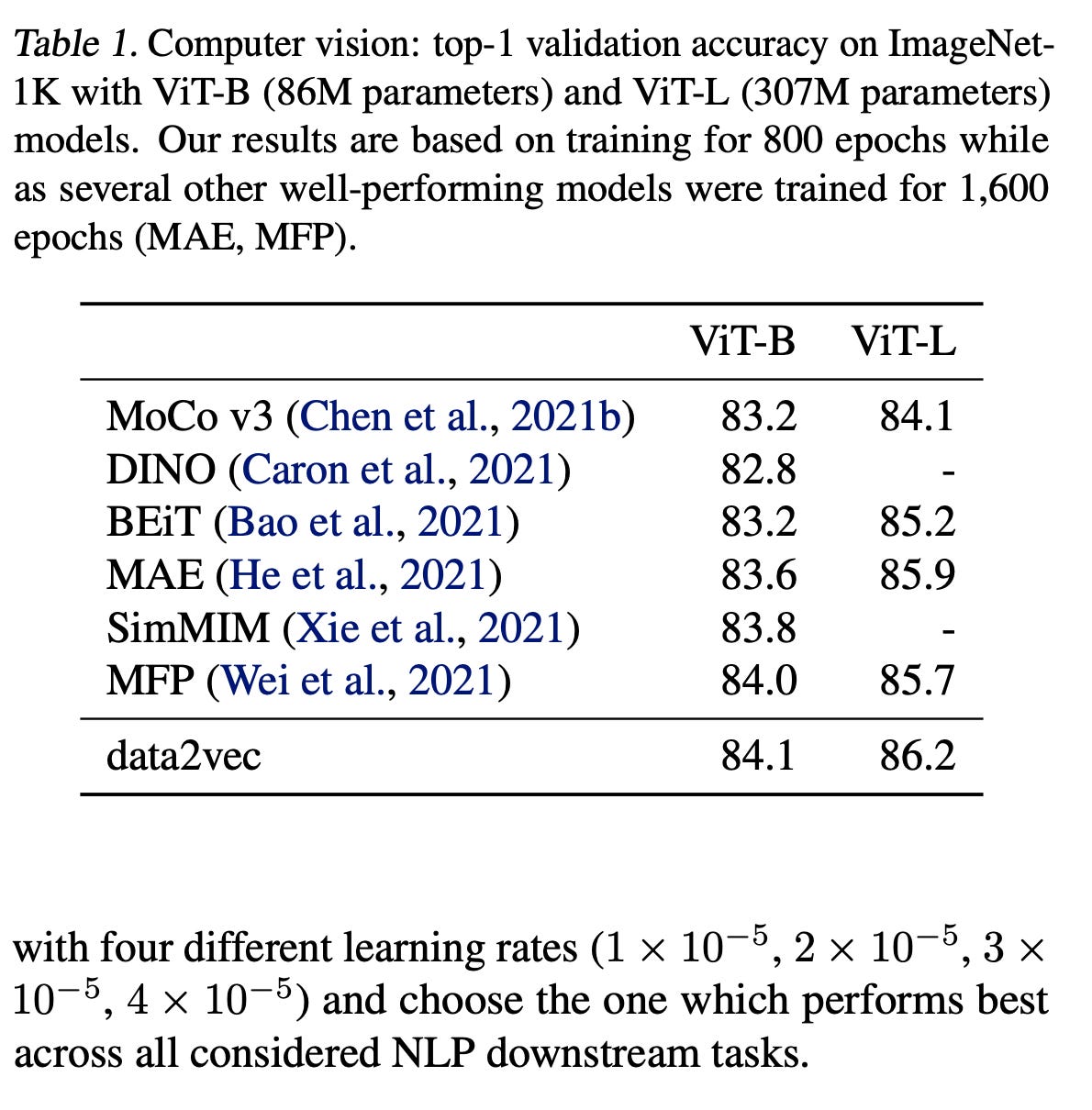

Meta מציג את התוצאות הטובות ביותר עבור תחרות זיהוי התמונות הנכבדה של ImageNet.

מטא 2022

כאשר משתמשים ב-ViT כדי לנסות לפתור את מבחן ImageNet הסטנדרטי של זיהוי תמונות, התוצאות שלהם מגיעות בראש החבילה, עם דיוק של 84.1%, טוב יותר מהציון של 83.2% שקיבל צוות במיקרוסופט שעבר הכשרה מוקדמת ViT, בראשותו של Hangbo Bao, אשתקד.

ואותו data2vec Transformer מפלט תוצאות שהן מתקדם לזיהוי דיבור והן תחרותיות, אם לא הטובות ביותר, ללימוד שפה טבעית:

תוצאות ניסוי מראות ש-data2vec יעיל בכל שלושת השיטות, ומגדיר מצב חדש ל-ViT-B ו-ViT-L ב-ImageNet-1K, תוך שיפור ביחס לעבודה הקודמת הטובה ביותר בעיבוד דיבור על זיהוי דיבור וביצועים דומים ל-RoBERTa על מדד הבנת השפה הטבעית של GLUE.

העיקר הוא שזה קורה ללא כל שינוי של הרשת העצבית כך שתהיה על תמונות, ואותו הדבר עבור דיבור וטקסט. במקום זאת, כל סוג קלט נכנס לאותה רשת ומשלים את אותה משימה כללית מאוד. משימה זו היא אותה משימה שרשתות רובוטריקים משתמשות בה תמיד, המכונה "חזוי מסכה".

גַם: דוגמנית העל של גוגל: DeepMind Perceiver היא צעד בדרך למכונת AI שיכולה לעבד כל דבר והכל

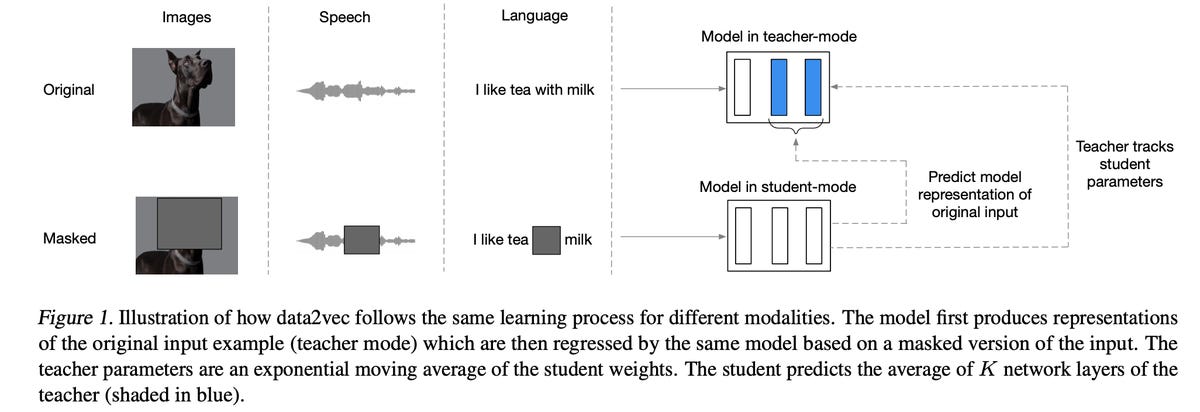

עם זאת, הדרך שבה data2vec מבצעת חיזוי מסכה היא גישה המכונה למידה "בפיקוח עצמי". בסביבה בפיקוח עצמי, רשת עצבית מאומנת, או מפותחת, על ידי הצורך לעבור שלבים מרובים.

ראשית, הרשת בונה ייצוג של ההסתברות המשותפת לקלט נתונים, בין אם זה תמונות או דיבור או טקסט. לאחר מכן, בגרסה שנייה של הרשת יש כמה מאותם פריטי נתוני קלט "מסויכים", שנותרו בלתי נחשפים. עליה לשחזר את ההסתברות המשותפת שהגרסה הראשונה של הרשת בנתה, מה שמאלץ אותה ליצור ייצוגים טובים יותר ויותר של הנתונים בעצם מילוי החסר.

סקירה כללית של גישת data2vec.

מטא 2022

שתי הרשתות, זו עם התבנית המלאה של ההסתברות המשותפת, וזו עם הגרסה הלא שלמה שהיא מנסה להשלים, נקראות, באופן הגיוני, "מורה" ו"תלמיד". רשת הסטודנטים מנסה לפתח את תחושת הנתונים שלה, אם תרצו, על ידי שחזור מה שהמורה כבר השיג.

אתה יכול עיין בקוד של הדגמים ב-Github.

כיצד פועלת הרשת העצבית מורה ותלמיד עבור שלושה סוגי נתונים שונים מאוד? המפתח הוא שה"מטרה" של הסתברות משותפת, בכל שלושת מקרי הנתונים, איננה סוג נתוני פלט ספציפי, כפי שקורה בגרסאות של השנאי לסוג נתונים ספציפי, כגון BERT של גוגל או GPT-3 של OpenAI .

במקום זאת, data2vec תופס כמה שכבות של רשתות עצביות שכן בתוך הרשת העצבית, אי שם באמצע, שמייצגת את הנתונים לפני שהם מופקים כל אחד כפלט סופי.

כפי שכותבים המחברים, "אחד ההבדלים העיקריים בשיטה שלנו […] מלבד ביצוע חיזוי במסווה, הוא השימוש ביעדים המבוססים על ממוצע של שכבות מרובות מרשת המורים." באופן ספציפי, "אנו נסיגה של ייצוגים מרובים של שכבות רשתות עצביות במקום רק השכבה העליונה", כך ש"data2vec חוזה את הייצוגים הסמויים של נתוני הקלט."

הם מוסיפים, "בדרך כלל אנו משתמשים בפלט של ה-FFN [רשת היזון קדימה] לפני החיבור האחרון בכל בלוק כמטרה", כאשר "בלוק" הוא המקבילה ל-Transformer של שכבת רשת עצבית.

הנקודה היא שכל סוג נתונים שנכנס הופך לאותו אתגר עבור רשת התלמידים של שחזור משהו בתוך הרשת העצבית שהמורה חיבר.

ממוצע זה שונה מגישות אחרונות אחרונות לבניית רשת אחת כדי למחוק את כל הנתונים. לדוגמה, בקיץ שעבר, יחידת DeepMind של גוגל הציעה את מה שהיא מכנה "Perceiver", גרסה רב-מודאלית משלה של ה-Transformer. ההכשרה של הרשת העצבית Perceiver היא התהליך הסטנדרטי יותר של הפקת פלט שהוא התשובה למשימה מסומנת ומפוקחת כגון ImageNet. בגישה בפיקוח עצמי, data2vec לא משתמש בתוויות האלה, זה רק מנסה לשחזר את הייצוג הפנימי של הרשת של הנתונים.

מאמצים שאפתניים עוד יותר טמונים בכנפיים. ג'ף דין, ראש מאמצי הבינה המלאכותית של גוגל, התגרה באוקטובר על "נתיבים", מה שדין טוען הוא "ארכיטקטורת AI מהדור הבא" לעיבוד נתונים רב-מודאלי.

שימו לב, הגישה הכללית מאוד של data2vec לרשת עצבית אחת עבור מספר אופנים עדיין מכילה מידע רב על סוגי הנתונים השונים. תמונה, דיבור וטקסט מוכנים כולם על ידי עיבוד מוקדם של הנתונים. בדרך זו, ההיבט הרב-מודאלי של הרשת עדיין מסתמך על רמזים לגבי הנתונים, מה שהצוות מתייחס אליו כ"מקודדי קלט קטנים ספציפיים למודאליות".

גַם: גוגל חושפת את 'Pathways', AI מהדור הבא שניתן לאמן לריבוי משימות

"למרות משטר הלמידה המאוחד, אנחנו עדיין משתמשים במחלצי תכונות ספציפיות למודאליות ואסטרטגיות מיסוך", הם מסבירים.

מכאן שעדיין לא הגענו לעולם שבו רשת עצבית מאומנת ללא שום היגיון בסוגי נתוני הקלט. אנחנו גם לא נמצאים בנקודת זמן שבה הרשת העצבית יכולה לבנות ייצוג אחד המשלב את כל סוגי הנתונים השונים, כך שהרשת העצבית לומדת דברים בשילוב.

עובדה זו מתבהרת מחילופי דברים ביניהם ZDNet והמחברים. ZDNet פנה אל Baevski והצוות ושאל, "האם הייצוגים הסמויים המשמשים כמטרות הם קידוד משולב של כל שלושת האופנים בכל שלב בזמן נתון, או שהם בדרך כלל רק אחד מהאופנים?"

Baevski וצוות משיבים שזה המקרה האחרון, ושלהם reply מעניין לצטט בהרחבה:

המשתנים הסמויים אינם קידוד משולב עבור שלושת השיטות. אנו מכשירים מודלים נפרדים לכל אופציה אך התהליך שבאמצעותו לומדים המודלים זהה. זהו החידוש העיקרי של הפרויקט שלנו שכן לפני כן היו הבדלים גדולים באופן שבו מודלים מאומנים באופנים שונים. מדעני מוח מאמינים גם שבני אדם לומדים בדרכים דומות על צלילים ועל העולם החזותי. הפרויקט שלנו מראה שלמידה בפיקוח עצמי יכולה לעבוד באותו אופן גם עבור אופנים שונים.

בהתחשב במגבלות הספציפיות למודאליות של data2vec, רשת עצבית שיכולה להיות באמת רשת אחת שתשלוט בכולם נותרה הטכנולוגיה של העתיד.